4.UDAU NA HABARI

4.1. Entropy kama kipimo cha kutokuwa na uhakika wa takwimu. Katika moja ya mijadala ya hivi karibuni ya umma kuhusu masuala ya elimu, ilipendekezwa kuwa kila mtu aliyeelimishwa anapaswa kuelewa asili ya msingi ya dhana ya kutokuwa na uhakika. Katika miongo ya hivi karibuni, neno hili limechukua uongozi kwa ujasiri kati ya kanuni za kwanza za kimwili, kupenya katika maeneo mapya ya ujuzi. Katika sehemu hii, unapaswa kufahamiana zaidi na dhana hii na kuelewa uhusiano kati ya kutokuwa na uhakika na sifa za kuunda mfumo.

Kutokuwa na uhakika kunaweza kuwa na asili tofauti. Moja ya aina zake ni haijulikani- kuzingatiwa na nadharia ya maarifa na falsafa; aina hii ya kutokuwa na uhakika hutokea wakati sisi, kwa mfano, tunapouliza swali "Je, kuna uhai kwenye sayari nyingine?" au “Je, kuna ustaarabu mwingine?” Nakadhalika.

Aina nyingine ya kutokuwa na uhakika kutokuwa wazi, kizunguzungu,- kwa mfano, "Ni chembe ngapi za mchanga unahitaji kuchukua ili kuunda rundo ndogo"? Tunakutana na kutokuwa na uhakika wa aina hii katika mechanics ya quantum. Kwa msingi wake, toleo lisilo la kawaida la thermodynamics limejengwa, ambalo linaweza kujibu swali kama hilo: "ni chembe ngapi unahitaji kuunda macrolevel na ni nini kutawanya kwa idadi hii?" Kutokuwa na uhakika huu ni lengo; ni tabia kwamba haiwezi kuondolewa wakati wa mchakato wa kipimo. Katika hisabati, nadharia fuzzy seti inahusika na kutokuwa na uhakika kama huo. Ikumbukwe kwa kupita kwamba blurriness ni mali ya tabia ya lugha: "mrefu (urefu gani?) kijana (umri gani hasa?) mtu (yeye ni nani?) aliingia chumbani (nini?), nk.

Aina ya tatu ya kutokuwa na uhakika ni ajali. Inategemea sheria za takwimu zilizoanzishwa na nadharia ya uwezekano. Aina hii ya kutokuwa na uhakika hutumiwa na fizikia ya takwimu na pamoja na kutokuwa na uhakika wa aina ya pili katika mechanics ya quantum. Kipengele tofauti cha kutokuwa na uhakika wa takwimu ni kwamba kipimo cha kiasi kinaweza kuanzishwa kwa ajili yake, ambacho kitajadiliwa hapa chini.

Hebu tuache kando kwa sasa swali la umuhimu wa vitendo wa kipimo cha takwimu cha kutokuwa na uhakika, kwa kuzingatia kiini chake. Hebu fikiria hali chache rahisi, ambazo tutaita majaribio A, B na C. Inachukuliwa kuwa msomaji anafahamu vipengele vya nadharia ya uwezekano.

Jaribio A litajumuisha kurusha sarafu. Katika jaribio hili kuna mawili yanayowezekana matokeo(k=2): "vichwa au mikia". Ni wazi, uwezekano wa kila matokeo ( i=1,2).

Jaribio B - kutupa kete ya pande sita. Tayari kuna matokeo sita yanayowezekana katika jaribio hili ( k=6). Uwezekano wa kila matokeo.

Jaribio C linahusisha kukunja kete mbili kwa wakati mmoja. Kwa uzoefu huu k=36 na.

Kutathmini kutokuwa na uhakika wa matokeo ya majaribio ni tathmini ya ugumu wa kutabiri matokeo ya jaribio. Ni wazi kwamba kati ya hali zote zilizoelezwa, uzoefu C una kutokuwa na uhakika wa juu, kwa kuwa idadi ya matokeo hapa ni kubwa zaidi na ni vigumu sana kuona matokeo ya uzoefu huu mapema.

Ili kuendelea na tathmini ya kiasi cha kutokuwa na uhakika, tunaunda mahitaji ya kimsingi ya chaguo la kukokotoa ambalo linafaa kuchukua jukumu la kipimo cha kutokuwa na uhakika. Tutaashiria kazi hii kwa barua H.

Sharti la kwanza. Kazi N inapaswa kuongezeka monotonically na kuongezeka kwa idadi ya matokeo ya majaribio.

Sharti la pili. Kazi N lazima iwe sawa na sifuri ikiwa kuna tokeo moja tu ( k=1). Hii inamaanisha kwamba ikiwa matokeo moja tu yanawezekana, basi hakuna kutokuwa na uhakika kunatokea na matokeo ya jaribio yanaweza kutabiriwa bila makosa.

Sharti la tatu. Hebu tuzingatie ukweli kwamba jaribio moja C linaweza kuzingatiwa kama majaribio mawili B, na tunahitaji kwamba jumla ya thamani ya entropy ya majaribio mawili B iwe sawa na entropy ya jaribio C.

au kwa ujumla si kwa mbili, lakini n majaribio rahisi

Ikiwa hitaji la tatu halikufikiwa, basi tathmini ya kutokuwa na uhakika wa uzoefu C ingegeuka kuwa ya kupingana na ingetegemea tafsiri ya kibinafsi ya uzoefu yenyewe - ikiwa kuzingatia uzoefu huo C ulifanyika, au ikiwa kete hazikufanyika. kuanguka kwa wakati mmoja na uzoefu mbili B. Kukubalika kwa mahitaji haya ni sawa na kuanzisha sifa za kuongeza kwa tathmini ya kutokuwa na uhakika ya baadaye. Kwa default, inachukuliwa kuwa vipengele (mifupa) katika swali haviingiliani na kila mmoja. Katika tafsiri ya thermodynamic, hii ni sawa na kukubali mfumo bora.

Wacha tusuluhishe hesabu ya utendaji (4.1) ya chaguo la kukokotoa . Ili kufanya hivyo, tunatofautisha pande zote mbili za usemi (4.1-1) kuhusiana na k, kwa kutumia hitaji la monotonicity ya kazi:

Sasa tunatofautisha (4.1) kwa heshima na n

Hebu tugawanye mlingano (4.2) kwa (4.3)

ambayo ni sawa

Kuunganisha usemi huu na kutumia jedwali muhimu kwa upande wa kulia, tunapata

iko wapi ujumuishaji mara kwa mara.

Kutoka kwa usemi wa mwisho

Tangu na kuongezeka k ongezeko la entropy (mahitaji ya kwanza), basi C>0, na usemi huu unaweza kuandikwa upya katika fomu ifuatayo ya mwisho:

,a>1.

Inafuata kutoka kwa hili kwamba pia inakidhi mahitaji ya pili. Kuchagua msingi wa logariti kwa a>1 haijalishi na huamua tu chaguo la kitengo cha kipimo cha kutokuwa na uhakika. Zinazotumiwa zaidi ni logarithmu za binary au asili. Ikiwa logarithmu za binary zinatumiwa, basi kutokuwa na uhakika wa jaribio ambalo lina matokeo mawili yanayowezekana kwa usawa (jaribio A) huchukuliwa kama kipimo cha kutokuwa na uhakika. Hali hii inalingana na entropy ya seli moja ya msingi ya kompyuta, ambayo huhifadhi ama 0 au 1. Kwa seli hii.

Kitengo hiki cha kipimo kinaitwa kidogo(kutoka kwa binarydiget ya Kiingereza - kitengo cha binary).

Kwa hiyo, lini k matokeo yanayowezekana sawa, kutokuwa na uhakika wa uzoefu ni

Wapi uk- uwezekano wa matokeo ya jaribio.

Kwa kuzingatia hilo kwa matokeo yanayowezekana sawa

basi, kuzidisha (4.4) kwa moja kwa namna ya jumla ya uwezekano, tunapata

Kila neno lililo upande wa kulia wa usemi huu linaweza kuzingatiwa kama mchango wa matokeo ya mtu binafsi kwa kutokuwa na uhakika wa jumla wa uzoefu. Katika kesi ya matokeo yanayowezekana kwa usawa, mchango wa kila mmoja wao kwa kutokuwa na uhakika wa jumla wa jaribio ni sawa na fomula (4.5) huanguka katika (4.4).

Usemi (4.5) unasasishwa kwa urahisi kwa kesi wakati uwezekano wa matokeo ni tofauti. Katika kesi hii, (4.5) inaweza kuzingatiwa kama wastani wa uzoefu, na uwezekano kabla ya kumbukumbu huchukua maana ya vigawo vya uzani. Sasa inachukuliwa kuwa mchango wa kila matokeo kwa kutokuwa na uhakika wa uzoefu sio lazima kuwa sawa. Mfano wa hali iliyo na matokeo yasiyo sawa ni uzoefu wa kuchora mpira bila mpangilio kutoka kwa urn iliyo na idadi kubwa ya mipira ya rangi kadhaa. Uhifadhi kuhusu idadi kubwa ya mipira ulifanywa mahususi ili kusisitiza asili ya uwezekano wa kipimo cha kutokuwa na uhakika.

Usemi (4.5) unaweza kuandikwa kwa umbo fupi

Ikiwa idadi ya majaribio N, kisha kwa kuzingatia nyongeza ya entropy

Entropy kama kipimo cha kutokuwa na uhakika ilianzishwa na mwanahisabati wa Marekani Claude Shannon mwaka wa 1949 wakati akiendeleza nadharia ya hisabati ya mawasiliano. Chaguo la kukokotoa kama (4.6), au entropy ya chaguo mara nyingi pia huitwa Shannon entropy. Kwa kuwa dhana ya entropy leo inakuwa ya kisayansi ya jumla, dalili ya asili yake ya habari, kama sheria, hutumiwa tu katika hali ambapo maandishi yanapaswa kutofautisha kati ya habari na thermodynamic (ya kimwili) entropy.

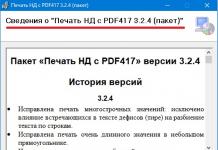

Mchele. 4.1. Utegemezi wa entropy kwa matokeo mawili ya jaribio

Hebu fikiria baadhi ya mali ya entropy. Hebu tutambue kwanza kabisa kwamba entropy haiwezi kuchukua maadili hasi: tangu , daima ni chanya. Ikiwa, basi (kwa uthibitisho, kutokuwa na uhakika wa aina lazima kufichuliwe). Ikiwa, basi pia.

Tangu lini tu uk=0 au uk=1, basi entropy ya uzoefu ni sifuri tu katika kesi wakati moja ya uwezekano ni sawa na moja na, kwa hiyo, wengine wote ni sawa na sifuri. Hali hii inakubaliana vyema na maana ya wingi H kama kipimo cha kutokuwa na uhakika: katika kesi hii, uzoefu hauna kutokuwa na uhakika wowote, kwani matokeo ya uzoefu yanaweza kutabiriwa mapema.

Mchoro 4.1 unaonyesha grafu ya kazi H kwa matokeo mawili ya jaribio, ambayo ni wazi jinsi entropy inabadilika wakati moja ya matokeo ya jaribio yanabadilika kutoka sifuri hadi moja. Inafuata kutoka kwa grafu kwamba thamani ya juu ya entropy inalingana na matukio yanayowezekana kwa usawa. Katika kesi hii, thamani ya juu ya entropy

Katika kesi ya jumla, i.e. si kwa mbili, lakini k matokeo ya jaribio, thamani ya juu ya entropy inalingana.

Ukweli kwamba upeo wa entropy unalingana na matukio yanayowezekana sawa ni sawa na maana ya entropy. Hakika, katika kesi ya matukio yanayowezekana kwa usawa, haiwezekani kutoa upendeleo kwa matokeo yoyote na hivyo ni vigumu sana kutabiri matokeo.

4.2. Entropy kama kipimo cha kiasi cha habari. Wacha turudi kwenye majaribio rahisi zaidi na sarafu au kufa. Kabla ya kufanya jaribio, kuna kutokuwa na uhakika kuhusishwa na kutojua matokeo ya jaribio. Baada ya jaribio, i.e. baada ya kupokea matokeo, kutokuwa na uhakika huu huondolewa na kutoweka. Walakini, hii sio wakati wote, na katika mazoezi kuna kesi mara nyingi wakati kutokuwa na uhakika bado kunabaki baada ya mwisho wa jaribio.

Ikiwa kutokuwa na uhakika kabla ya jaribio lilikuwa N(kutokuwa na uhakika wa kipaumbele), na baada ya majaribio -( kutokuwa na uhakika wa nyuma), basi ni wazi kutokuwa na uhakika ulioondolewa wakati wa jaribio itakuwa:

Tofauti hii inaitwa kiasi cha habari.

Hivyo, kiasi cha habari ni kiasi cha kutokuwa na uhakika kilichoondolewa. Katika hali fulani, wakati kutokuwa na uhakika kama matokeo ya jaribio kumeondolewa kabisa, kama ilivyokuwa katika majaribio A, B, na C, tunapata: Ingawa hapa kiasi cha habari ni sawa na entropy, mtu anapaswa kukumbuka maana tofauti ya kiasi cha habari na entropy. Entropy (kutokuwa na uhakika) ipo kabla ya jaribio, wakati maelezo yanaonekana baada ya jaribio. Inapaswa kuzingatiwa tu kwamba kwa tathmini ya kiasi cha habari hakuna kipimo kingine isipokuwa entropy. Uhusiano kati ya dhana ya entropy na kiasi cha habari inafanana na uhusiano kati ya dhana za kimwili za uwezo (entropy) na tofauti zinazowezekana (kiasi cha habari).

Kiasi cha habari, kama entropy, hupimwa kwa biti. Sehemu moja ya habari ni kiasi cha habari inayoelezea ni matukio gani kati ya mawili yanayowezekana kwa usawa yalitokea. Kwa mfano, kiasi cha habari kilicho katika seli moja ya msingi ya kompyuta iliyo na 0 au 1 ni biti moja.

Wacha tuchunguze mfano ambao kutokuwa na uhakika wa nyuma kungeonekana. Acha njia ya kuorodhesha chaguzi itafute mzizi wa mlinganyo sahihi hadi nusu-jumla. Inajulikana mapema kuwa thamani ya mzizi iko katika safu kutoka 1 hadi 100, kwa hivyo unapaswa kupitia chaguzi 200. Kisha kutokuwa na uhakika wa thamani ya mizizi katika toleo linalowezekana kwa usawa (4.4) itakuwa H = logi 2 200 = 13.3 bits.

Tuseme lahaja 150 za maadili yanayowezekana yameangaliwa, lakini hakuna mzizi uliopatikana. Hata hivyo, je, kuna habari fulani inayopatikana kuhusu maana ya mzizi? Bila shaka, na ili kuamua, ni muhimu kwanza kupata mabaki (a posteriori) kutokuwa na uhakika: H 1 = logi 2 (200 - 150) = 5.6. Kisha kiasi kinachohitajika cha habari kitakuwa = 13.3 - 5.6 = 7.7 bits.

Entropy ya masharti. Hebu fikiria dhana ya kiasi cha habari kwa kutumia mfano wa maambukizi ya ishara. Acha kikundi cha mawimbi kisambazwe kwa nambari ya Morse:

Hadi herufi inayofuata ipokewe kwenye sehemu ya kupokea, kuna kutokuwa na uhakika "ni ishara gani itatumwa?" Kutokuwa na uhakika huu kunaweza kuwa na sifa ya entropy "kwa kila tabia" (4.6) na idadi ya matokeo k = 3 (dot, dashi, nafasi) na uwezekano p i (i = 1, 2, 3). Uwezekano wa dot, dashi au nafasi inayoonekana kwenye mwisho wa kupokea, i.e. Wataalamu wanajua uwezekano (frequencies) wa kutumia ishara katika lugha fulani kutokana na uchanganuzi wa takwimu wa ujazo mkubwa wa matini katika lugha hiyo. Kwa kuhesabu entropy kwa kila tabia, kwa kutumia formula (4.6) ni rahisi kuamua entropy jumla ya ujumbe (4.7). Katika mfano huu kuna herufi 10 ikijumuisha nafasi na kwa hivyo N = 10.

Kwa hivyo, kwenye mwisho wa kupokea, kabla ya kupokea ujumbe, kulikuwa na kutokuwa na uhakika wa kwanza (4.7) au ishara moja (4.6). Baada ya kupokea ujumbe, kutokuwa na uhakika kuliondolewa na taarifa I=H– 0 ilipokelewa.

Walakini, hali hii rahisi hutokea ikiwa ujumbe unapitishwa bila kuingiliwa ( channel bila kelele) Ikiwa kuna kelele, basi hatua yake inaongoza kwa ukweli kwamba ishara iliyopitishwa inaweza kubaki sawa (i-th) au kubadilishwa kwa ajali na ishara nyingine yoyote (n-th). Uwezekano wa uingizwaji kama huo unaashiria p (y n x i), ambapo x inarejelea ishara iliyopitishwa, na y kwa ishara iliyopokelewa kwa mpokeaji. Katika chaneli bila kuingiliwa y n = x i . Uwezekano p(y n x i) unaitwa uwezekano wa masharti x i) ni uwezekano kwamba ishara ya i-th iliyotumwa inalingana na ishara ya n-th kwenye mwisho wa kupokea. Bila shaka, hali hii inaweza pia kuzingatiwa kutoka upande wa transmitter, kwa kutumia uwezekano wa masharti ya fomu p (x i y n). Katika kesi hii, р (x i y n) ni uwezekano kwamba ishara ya n-th iliyopokea kwenye mwisho wa kupokea inafanana na ishara ya i-th kwenye mwisho wa kusambaza. Dhana ya uwezekano wa masharti inatanguliza entropy ya masharti kama kipengele cha uwezekano wa masharti. Kwa ujumla, hii imeandikwa katika nukuu ifuatayo:

I(X,Y) = H(X) – H(XY)

I(X,Y) = H(Y) - H(YX)

Katika misemo hii inayofanana, entropy ya masharti ina jukumu la entropy ya nyuma, na kiasi cha habari ni. kipimo cha ulinganifu vitu viwili vya nasibu X na Y.

Kipimo hiki kinatuwezesha kuelewa uhusiano kati ya dhanahabari na wingi wake. Habari ni kiakisi cha kitu kimoja hadi kingine. Katika mfano huu, vitu hivi ni mpokeaji na mtoaji. Kiasi cha wastani cha habari ni tabia ya nambari ya utimilifu wa tafakari hii, kiwango cha mawasiliano, na mwishowe, kiwango cha mwingiliano vitu hivi. Lakini wakati wa kuingiliana, vitu vinaathiri kila mmoja, na tumezoea kutofautisha kati ya sababu na athari. Maelezo ya kiasi cha habari ni aina nyingine ya maelezo ya mwingiliano ambayo hayahusiani kwa vyovyote na maelezo ya asili ya sababu na athari.. Aina hii ya mawasiliano ni ya kawaida kwa NVT.

Hapa ni muhimu kurejelea aya ya 3.6, ambapo tayari tumegusia juu ya mapungufu ya utaratibu wa classical, sababu-na-athari wakati wa kuelezea mwingiliano katika mfumo wazi.

4.3.Entropy ya seti inayoendelea. Iliyopitiwa hapo awali entropy ya seti tofauti. Hii inamaanisha kuwa mifumo ilikusudiwa ambapo idadi ya matokeo yanayowezekana (vipengee vya seti) ni ya mwisho. Walakini, mara nyingi tunakutana na hali ambapo idadi ya vipengee inaweza kuwa kubwa kiholela. Inajulikana kutokana na nadharia ya uwezekano kwamba katika kesi hii mtu haipaswi kushughulika na uwezekano wa matokeo ya mtu binafsi, ambayo ni sawa na sifuri, lakini kwa wiani wa usambazaji wa uwezekano. Chaguo hili la kukokotoa lina sifa ya kwamba wingi ni uwezekano wa kutofautisha kwa manufaa kwetu x(thamani ya mzizi katika mfano wa kifungu cha 4.2.) itachukua maadili katika safu kutoka x kabla x+dx.

Sasa, ili kukadiria kutokuwa na uhakika, ni muhimu kuamua kwa entropy ya seti inayoendelea, ambayo, kwa kulinganisha na entropy ya seti ya discrete (4.5), ina fomu ya fomu (4.5).

![]() . (4.9)

. (4.9)

Kama mfano wa kutumia chaguo hili la kukokotoa, tutajaribu kukadiria kutokuwa na uhakika wa uzoefu unaohusishwa na utafutaji wa nasibu katika muda fulani wa thamani ya mzizi (ona sehemu ya 4.2) bila vizuizi kwenye usahihi wa utafutaji.

Kwa kuongeza mahitaji ya usahihi wa jibu, mtu anaweza kutarajia idadi kubwa ya matokeo iwezekanavyo ya jaribio. Katika kesi hii, uwezekano wa kila matokeo huelekea sifuri, na mzizi unaotaka unaweza kuchukua maadili yote yanayowezekana (isitoshe) kwa muda fulani wa nambari kutoka 0 hadi 200. Wacha tujaribu kutumia entropy ya seti inayoendelea kwa sawa. tatizo. Wacha tuanzishe sehemu ya urefu l=x 1 -x vitengo 0 jamaa. Uwezekano wa kupata thamani ya mzizi katika eneo dx ni dx/ 1 . Kwa upande mwingine, uwezekano huu ni kwa ufafanuzi. Kwa hiyo, kwa kesi inayowezekana sawa = dx/l u= 1/ l. Kubadilisha thamani hii katika (4.), ni rahisi kupata H = logi 2 l = 5.6 bits.

Wacha tulinganishe matokeo yaliyopatikana na mfano katika aya ya 4.2. Katika kesi ya seti ya kipekee, entropy hutumia idadi ya vipindi tofauti kwenye sehemu iliyochaguliwa, na katika kesi ya seti inayoendelea, urefu wa jamaa wa sehemu yenyewe.. Kumbuka kwamba urefu lazima uonyeshwe katika umbo linalolingana, vinginevyo kiasi cha dimensional kitaonekana chini ya logariti. Kiwango cha kupunguzwa kwa fomu ya jamaa sio umuhimu wa msingi kwa entropy ya habari, tangu mwanzo kabisa entropy ilianzishwa kwa usahihi kwa sababu (hadi mara kwa mara ya ushirikiano, angalia utaratibu wa ushirikiano katika aya ya 4.1).

Entropy ya kuweka kuendelea au entropy tofauti(4.9) ina sifa nyingi za entropy iliyowekwa tofauti.

Katika fasihi ya kisasa mtu anaweza kupata ukosoaji wa dhana ya tofauti entropy na dhana inayotokana kiasi tofauti cha habari. Uhakiki huu katika asili yake unapatana na ukosoaji wa dhana ya mwendelezo, iliyojadiliwa hapo awali katika aya ya 3.5.

4.4.Entropy kama kipimo cha utofauti, machafuko, machafuko. Hadi sasa, wazo la entropy limehusishwa na kutokuwa na uhakika. Entropy inaruhusu tafsiri nyingine. Wacha tufikirie mfumo unaojumuisha chumba ambamo kuna N mipira ya aina tofauti, kwa mfano, katika rangi . Inachukuliwa kuwa N ni idadi kubwa ya kutosha. Wacha tuonyeshe sehemu ya mipira i-aina (rangi) -. Ikiwa tutafanya jaribio kwenye mfumo, ambalo linajumuisha kutoa mpira mmoja bila mpangilio, basi entropy ya jaribio moja, kulingana na (4.6), itakuwa:

Inachukuliwa kuwa ukubwa wa mipira ni sawa, vinginevyo uwezekano wa kuchimba mipira i-aina hiyo haitalingana kabisa na sehemu yao kwenye chumba. Entropy ya majaribio yote kwenye mfumo

Kwa kuwa upande wa kulia wa misemo ya mwisho ni pamoja na vigezo vinavyoashiria yaliyomo kwenye mfumo, swali linatokea ikiwa, bila kutaja majaribio na mipira, inawezekana kuelewa kutoka kwa mtazamo gani kazi hizi zinaonyesha yaliyomo kwenye chumba.

Kazi ya kwanza kati ya hizo mbili ina sifa kiwango cha machafuko mfumo au kiwango cha utofauti ndani yake, kwa kuzingatia tabia iliyochaguliwa ya kutofautisha mambo ya mfumo (rangi ya mipira). Ikiwa kulikuwa na mipira ya aina moja kwenye chumba, basi moja ya maadili ya uwezekano uk=z itakuwa sawa na moja, na zingine zote zingekuwa sifuri, na entropy itachukua thamani ya sifuri. Hii itamaanisha kuwa mfumo umeagizwa kabisa, au, ambayo ni kitu kimoja, kwamba hakuna tofauti katika mfumo kulingana na sifa iliyopimwa (rangi).

Kitendaji cha pili (4.11) hupima machafuko (anuwai) katika mfumo kwa njia tofauti. Tofauti kati ya kazi hizi mbili inaweza kuonyeshwa na mfano ufuatao. Ikiwa chumba kimegawanywa katika sehemu mbili, basi na idadi kubwa ya mipira ndani yake uwiano wa mipira. i-aina ya kila moja ya sehemu hizo mbili itabaki sawa, lakini idadi ya mipira itapunguzwa kwa nusu, na shida iliyokadiriwa na formula (4.11) pia itapunguzwa kwa nusu. Hata hivyo, kiwango cha machafuko kwa kila sehemu mbili, inakadiriwa na kazi (4.10), itabaki sawa.

Kwa mlinganisho na mfano uliozingatiwa hivi karibuni, fomula (4.11) inaweza kutumika kukadiria shida ya mtiririko wa mchanganyiko wa dutu yoyote. Katika kesi hii, mkusanyiko i sehemu ya -th katika sehemu za mole; N- kiwango cha mtiririko au idadi ya molekuli zinazopitia sehemu fulani ya msalaba kwa kila wakati wa kitengo. Tangu nambari N katika matatizo ya vitendo daima ni kubwa sana, tunaweza kuhamia kwa kiwango tofauti kwa entropy. Kwa mfano, kugawanya pande za kushoto na za kulia kwa nambari ya Avogadro, tunapata

Wapi F- kiwango cha mtiririko, kmol / kitengo. wakati. Uteuzi wa entropy kwenye kiwango kipya unabaki sawa.

Kwa hivyo, entropy hutathmini utofauti wa vipengele katika mfumo kulingana na kipengele fulani ambacho kinaweza kutuvutia katika kazi fulani; tazama vifungu 4.6 na 4.7.

Wacha tukumbuke kuwa usemi (4.10) unalingana, hadi jambo fulani, na usemi wa thermodynamic wa molar entropy ya mchanganyiko wa gesi bora.

S= –R, (4.13)

ambapo R ni gesi ya kudumu.

Katika mfano huu, mtu anaweza kutambua uhusiano kati ya entropy ya habari, iliyoletwa katika sehemu zilizopita bila kutumia kanuni za kimwili, na thermodynamics. Hapa pia ni muhimu kutambua sio tu mlinganisho wa nje, wa kimuundo. Entropy ya kuchanganya (4.13) ni entropy tu ya mchanganyiko bora wa thermodynamically. Wakati wa kuzingatia chumba na mipira, vikwazo vingine pia vilikubaliwa, kwa mfano, mahitaji ya ukubwa sawa wa mipira.

Entropy iliyoandikwa kwa suala la uwezekano mara nyingi huitwa kazi, tofauti na entropy iliyoonyeshwa kwa suala la sehemu za mole, ambayo inaitwa sifa.

4.5 Uunganisho wa entropy ya habari na fizikia. Wazo la entropy lilianzishwa kwanza katika thermodynamics na Clausis kama uhusiano unaounganisha ongezeko la msingi la entropy. dS na kiasi cha msingi cha joto dQ kwa joto T

dS = dQ/T(4.14)

Usemi huu unasema kidogo juu ya kiini cha mwili cha entropy. Katika fizikia, majaribio yamefanywa mara kwa mara kufunua yaliyomo katika dhana hii, ikiongozwa na dhana za mfano.

Boltzmann entropy. Wacha tuzingatie mlinganyo unaojulikana wa Boltzmann kulingana na mbinu ya takwimu

Wapi k B- Boltzmann mara kwa mara, k B=1.3810J/K;W - idadi ya mataifa madogo.

Ili kuelewa kiini cha mbinu za takwimu, kama mfano wa awali, hebu tuzingatie gesi kama mkusanyiko wa idadi kubwa ya chembe. Jambo la kwanza ambalo linaonekana kuwa muhimu kufanya wakati wa kuunda mfano wa hesabu wa tabia ya chembe ni kujaribu kuandika equation ya mwendo kwa kila mmoja wao, kwa sababu gesi, angalau kwa makadirio ya kwanza, ni mfumo wa chembe zinazosonga. kulingana na sheria za mechanics ya Newton.

Hata hivyo, kwa mbinu hii, idadi ya equations inakuwa kubwa isiyofikiriwa, bila kutaja ukweli kwamba kuunganisha equations hizi, kasi ya awali na kuratibu za kila molekuli ni muhimu. Hata hivyo, njia hii sio ngumu tu, lakini pia haina matunda, kwa kuwa ujuzi wa trajectories na sheria ya mwendo wa molekuli ya mtu binafsi haitoi taarifa yoyote kuhusu mali ya gesi kwa ujumla. Ukweli ni kwamba katika mfumo unaojumuisha chembe nyingi, mifumo mipya, ya kitakwimu tu ya kimfumo au shirikishi hutokea ambayo haikuwepo katika mfumo wenye idadi ndogo ya chembe.

Kwa kutumia modeli iliyorahisishwa sana, wacha tufuatilie jinsi mali hizi mpya zinazohusiana na dhana ya Boltzmann entropy zinaonekana.

Kwa uwazi, hebu tuchukue mfumo wa chembe kumi tu ( N=10), iliyosambazwa zaidi ya viwango vinne vya nishati, kuwa na maadili ya nishati ya 1, 2, 3 na 4. Jumla ya nishati ya mfumo ni sawa na vitengo 20 vya jamaa. Kazi ni kueleza mazingatio fulani kuhusu hali ambayo mfumo utachukua ikiwa imeachwa yenyewe, i.e. kuhusu jinsi chembechembe zinavyosambazwa katika viwango vya nishati.

Ili kufanya hivyo, hebu tujue ni usambazaji gani wa nishati wa chembe zinazowezekana. Katika kesi hii, tutafautisha kati ya mabadiliko katika micro- na macrostate ya mfumo. Ikiwa kuna mabadiliko katika idadi ya chembe katika ngazi yoyote ya nishati, basi tutazungumzia kuhusu mabadiliko macrostates mifumo. Ikiwa kulikuwa na ubadilishanaji wa chembe kati ya viwango vya nishati, lakini idadi ya chembe katika kila kiwango cha nishati ilibaki sawa, tutarekodi mabadiliko. microstates mifumo. Kwa mtazamaji wa nje ambaye anafuatilia tu macrostates ya mfumo, mabadiliko ya asili ya microscopic yataenda bila kutambuliwa, na microstates itakuwa isiyojulikana. Macrostate moja inaweza kupatikana na microstates nyingi.

Kwa hivyo, moja ya macrostates inayowezekana katika mfumo unaozingatiwa wa chembe kumi ni kama ifuatavyo: katika kiwango cha kwanza cha nishati kuna chembe moja ( N 1 =1), kwa pili kuna chembe nane ( N 2 =8) na mmoja anashika kiwango cha tatu ( N 3 = 1). Ngazi ya nne haijakaliwa. Jumla ya nishati ni 11+82+13+ 40=20. Wacha tuchukue kuwa chembe zimehesabiwa. Kisha macrostate hii inaweza kupatikana kwa njia tofauti (kupitia microstates tofauti), kwa kuweka, kwa mfano, kwenye kiwango cha nishati chembe 1 kwa upande wake na namba 1, 2, 3, 4, 5, nk, i.e. kufanya upyaji upya mbalimbali wa chembe bila kusumbua macrostate ya mfumo.

![]() . (4.16)

. (4.16)

Hapa r- idadi ya viwango vya nishati; katika mfano huu r= 4.

Ikiwa sasa tunahamia kwenye macrostate nyingine, i.e. kuchukua usambazaji tofauti wa chembe juu ya viwango vya nishati, kwa mfano, N 1 =2,N 2 =7,N 3 =0 na N4=1 (jumla ya nishati 21+72+14 = 20), basi idadi ya njia za kutekeleza macrostate hii W inageuka kuwa sawa na 360.

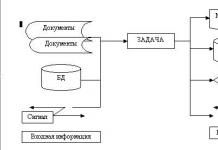

Wakati wa mchakato wowote wa udhibiti na uwasilishaji, taarifa ya ingizo hubadilishwa kuwa taarifa ya pato. Kawaida habari inaeleweka kama habari fulani, alama, ishara. Nadharia ya takwimu: dhana ya habari inaonyeshwa kama uondoaji wa kutokuwa na uhakika.

Habari inafafanuliwa kama habari ambayo ni kitu cha kuhifadhi, kupitisha na kupokea. Habari hupitishwa kwa kutumia ishara. Tathmini ya kiasi cha kupata habari inategemea wazo la upitishaji wa ujumbe kama mchakato wa nasibu wa stochastic kwa wakati.

Kutokuwa na uhakika huondolewa kupitia majaribio; kadiri kutokuwa na uhakika kulivyo juu, ndivyo thamani ya habari inavyopanda.

Kiwango cha kutokuwa na uhakika kinategemea idadi ya maadili ambayo idadi inaweza kuchukua na matokeo ya matukio.

Tofauti ya nasibu H(A) imedhamiriwa kama kipimo cha kiasi cha habari:

Wapi  -uwezekano wa matokeo.

-uwezekano wa matokeo.

Ishara ya minus inasimama kama fidia H (A) - hii ni entropy ya uzoefu A (fomula ilivumbuliwa na Claude Chinon).

H(A) kubwa zaidi, ndivyo kipimo cha ujinga kinavyoongezeka.

H(A) kubwa zaidi, ndivyo kipimo cha ujinga kinavyoongezeka.

Mkusanyiko wa habari kuhusu mfumo hupunguza entropy. Habari ni mchango fulani kwa entropy.

Wacha mfumo wa x upewe.

Kama  , Hiyo

, Hiyo

Wapi

Wapi

Kupokea habari ni onyesho la lengo la hali ya mfumo na inaweza kutumika kwa maambukizi, udhibiti, uamuzi, nk.

Habari sio kitengo cha nyenzo au nishati; haijaundwa kamwe, lakini hupitishwa na kupokelewa tu, lakini inaweza kupotea na kutoweka.

Kwa mujibu wa sheria ya pili ya thermodynamics, entropy huongezeka kwa sambamba na uharibifu wa miundo iliyopangwa, inayoelekea hali ya uwezekano wa machafuko.

Kipimo cha kipimo kinachukuliwa kuwa kiasi cha maelezo yaliyomo katika kutofautiana kwa nasibu, ambayo inakubaliwa kwa uwezekano sawa. Kitengo cha kiwango cha kutokuwa na uhakika kinachukuliwa kuwa entropy ya tukio la msingi ambalo lina matokeo mawili yenye uwezekano sawa na maadili mawili tofauti.

-kitengo cha binary au kidogo.

-kitengo cha binary au kidogo.

x-mfumo umeunganishwa

y-mfumo

I(x,y)=H(x)+H(y)-H(x,y), wapi

H(x,y) ni sehemu ya mfumo uliounganishwa.

, wapi,

, wapi,

Kwa ishara inayoendelea.

ambapo(x) ni msongamano wa uwezekano wa thamani x. Mbinu ya Chinon haizingatii maudhui ya kisemantiki.

ambapo(x) ni msongamano wa uwezekano wa thamani x. Mbinu ya Chinon haizingatii maudhui ya kisemantiki.

33. Dhana ya chanzo cha ergodic. Upungufu.

Kwa mazoezi, kuna vyanzo vya ergodic ambavyo viungo vya uunganisho vinaenea hadi idadi ya mwisho ya vyanzo vya awali. Katika chanzo cha ergodic  hakuna uhusiano, i.e.

hakuna uhusiano, i.e.

Uwakilishi wa hisabati wa ujumbe unaotokana na vyanzo vya ergodic ni Mnyororo wa Markov.

Mnyororo wa Markov n-ili ni mlolongo, utegemezi wa vipimo ambavyo, uwezekano wa matokeo fulani  katika jaribio inategemea matokeo yaliyotokea katika majaribio yoyote ya awali, lakini haitegemei matokeo ya awali.

katika jaribio inategemea matokeo yaliyotokea katika majaribio yoyote ya awali, lakini haitegemei matokeo ya awali.

Katika chanzo cha ergodic cha n mpangilio wa usambazaji  wakati k=1,2,…,m haibaki sawa, lakini inategemea herufi n za mwisho za jumbe zilikuwa nini.

wakati k=1,2,…,m haibaki sawa, lakini inategemea herufi n za mwisho za jumbe zilikuwa nini.

uwezekano wa kuchagua barua kutoka kwa alfabeti.

uwezekano wa kuchagua barua kutoka kwa alfabeti.

Idadi ya majimbo yanayowezekana imedhamiriwa na:  , ambapo m ni alfabeti, n ni mpangilio, M ni idadi ya hali zinazowezekana za chanzo.

, ambapo m ni alfabeti, n ni mpangilio, M ni idadi ya hali zinazowezekana za chanzo.

Ili kuamua jumla ya entropy ni muhimu:

ikiwa M = 1, basi tunapata formula ya classical ya Chinon.

Uunganisho wa uunganisho katika chanzo cha ergodic lazima unaambatana na mabadiliko katika usambazaji wa uwezekano, uchaguzi wa kipengele cha ujumbe kutoka hali hadi hali, ambayo pia husababisha kupungua kwa entropy, hii ina maana kwamba sehemu ya habari inayopitishwa na chanzo inaweza kuwa. iliyotabiriwa, ambayo ina maana haina haja ya kuambukizwa, kwa sababu inaweza kurejeshwa kwa upande wa kupokea. Chini ya entropy ya chanzo, habari zaidi inazalisha.

R-redundancy inaonyesha ufanisi wa chanzo.

Sababu ya R ni upekee na uwezekano wa waendeshaji kuchagua kati ya ujumbe.

Suala la uhusiano kati ya entropy na habari limejadiliwa kwa muda mrefu, kwa kweli, tangu kuundwa kwa kitendawili na "pepo wa Maxwell". Kwa muda fulani tatizo lilionekana kuwa la kufikirika. Sasa, hata hivyo, inakuwa muhimu, kwani inageuka kuwa inahusiana na maswali maalum: ni nini malipo ya entropy (na nishati) kwa habari, ni ukubwa gani wa chini wa seli ya habari, nk.

Maswali haya huwa makali hasa kutokana na umaalum wa kibayolojia. Kwanza, mifumo ya habari katika maumbile hai ni ndogo (hadubini) kwa saizi. Pili, wanafanya kazi kwa joto la kawaida, yaani, chini ya hali ambapo mabadiliko ya joto hayawezi kupuuzwa. Tatu, katika biolojia, kukariri na kuhifadhi habari ni muhimu sana. Kumbuka kwamba katika teknolojia matatizo ya uhamisho wa habari yanafaa zaidi; Kwa kutumia mfano wa uboreshaji wa upitishaji, kanuni za msingi za nadharia ya habari zilitengenezwa. Uangalifu mdogo ulilipwa kwa maswala ya mapokezi na uhifadhi wa habari. Katika biolojia, kinyume chake, masuala haya yanakuwa muhimu.

Bila kujifanya kutoa ufafanuzi mkali wa dhana ya "habari," tunasisitiza sifa zake mbili muhimu: 1) habari inahusisha kuchagua chaguo moja (au kadhaa) kutoka kwa wengi iwezekanavyo, 2) uchaguzi uliofanywa lazima ukumbukwe. Hebu tusisitize: hali ya pili - kukariri habari - ni muhimu sana. Kastler [P26] kwanza alielezea jambo hili mwaka wa 1960. Katika michakato ya uhamisho wa habari, "kukumbukwa" ina jukumu ndogo kuliko katika mapokezi, usindikaji na uhifadhi wa habari. Hakika, mfumo wa kusambaza unalazimika kukumbuka habari tu kwa muda wa maambukizi, ambayo kwa kanuni inaweza kuwa fupi. Katika biolojia, hali ya kukariri kwa muda mrefu, kinyume chake, ina jukumu muhimu.

Kiasi cha habari ni kiasi

![]()

iko wapi jumla ya chaguzi zinazowezekana, idadi ya chaguo zilizochaguliwa. Kiasi cha habari ni tofauti na sifuri ikiwa inajulikana kuwa kwa sababu fulani moja ya chaguzi za kipaumbele zilipatikana (lakini haijulikani ni ipi). Wingi huu ni wa juu ikiwa, yaani, inajulikana kuwa chaguo moja maalum ilitekelezwa (iliyochaguliwa). Thamani kama

Hakuna kinachojulikana. Msingi wa logarithm (yaani, binary) huchaguliwa kwa urahisi; Kitengo cha habari katika mfumo huu ni kidogo; inalingana na uchaguzi wa chaguo moja kati ya mbili zinazowezekana.

Usemi (12.8) unasasishwa kwa urahisi katika kesi wakati chaguzi za priori N zinaweza kupatikana kwa uwezekano na kutambuliwa nyuma na uwezekano basi.

Uchaguzi au utekelezaji wa chaguzi za nyuma zinaweza kufanywa kwa njia mbili tofauti; ama kama matokeo ya hatua ya nguvu za nje - katika kesi hii wanazungumza juu ya upokeaji wa habari kutoka kwa mfumo mwingine (wa mtu wa tatu), au kwa hiari, kama matokeo ya tabia isiyo na utulivu ya mfumo yenyewe - katika kesi hii kuzaliwa. (kuibuka) kwa habari mpya hufanyika.

Mfumo wa taarifa lazima uweze: a) kupokea taarifa, b) kuhifadhi au, ni nini sawa, kukumbuka taarifa, c) kutoa taarifa wakati wa kuingiliana na mfumo mwingine wa kipokeaji kuhusiana na mfumo unaozingatiwa. Inafuata kwamba mfumo wa habari lazima uwe wa multistationary.

Idadi ya majimbo thabiti huamua uwezo wa habari, i.e. kiwango cha juu cha habari ambacho mfumo unaweza kupokea:

![]()

Mfumo lazima upunguze. Hii ina maana kwamba sehemu halisi za nambari zote za sifa za majimbo ya stationary ni hasi; hili ni sharti la lazima kwa kukumbuka habari. Mfano wa mfumo kama huo ni billiard ya Kichina. Ni mpira kwenye ubao na pande, mashimo na pini. Mali ya mpira kwenye shimo maalum ni habari kuhusu hali ya mfumo.

Katika kiwango cha microscopic (molekuli), shida ya muundo wa mfumo wa habari inakuwa isiyo ya kawaida. Kwanza, katika mfumo wa multistationary, kila moja ya trajectories ya awamu iko tu katika sehemu fulani ya nafasi ya awamu (katika eneo la kivutio cha hali fulani). Kiasi cha awamu nzima haipatikani kwa kila trajectories. Hii ina maana kwamba mfumo wa habari si kijiometri kabisa na thermodynamically usawa. Lazima kuwe na digrii zilizochaguliwa za uhuru ambazo huhifadhi maadili yao kwa muda mrefu, na usipitie zote zinazowezekana.

Hebu tueleze hili kwa kutumia mfano wa billiards za Kichina. Digrii zilizochaguliwa za uhuru hapa ni kuratibu za mpira. Mabadiliko ya x na y ni mdogo kwenye kando ya visima; mpira hauwezi kuhamia shimo lingine bila uingiliaji wa nje. Ambapo

digrii zingine za uhuru zinazohusiana na mitetemo ya atomi za mpira na ubao zinaweza (na zaidi zinapaswa) kuwa ergodic.

Pili, hali ya kutokubalika, kama tulivyoona, inahusishwa na kukosekana kwa utulivu (na kwa hivyo machafuko) ya harakati za microscopic. Hii ina maana kwamba digrii sambamba za uhuru lazima ziwe za ergodic. Kwa hivyo, nafasi ya awamu ya mfumo wa habari lazima iwe stratified katika subsystems ergodic na nguvu. Walakini, utengano kama huo hauwezi kufanywa kwa ukali kabisa; digrii tofauti za uhuru zinahusiana kila wakati. Hii inajidhihirisha katika ukweli kwamba digrii za nguvu (habari) za uhuru hubadilika na kuna uwezekano fulani wa mabadiliko yao makubwa (kwa mfano, kurusha mpira kwenye shimo lingine) chini ya ushawishi wa mfumo mdogo wa ergodic (yaani kushuka kwa joto).

Katika mifumo ya habari ya macroscopic uwezekano huu hauwezekani, lakini katika mifumo ya microscopic lazima izingatiwe. Kwa hivyo, masharti ya multisttationarity na dissipativity hayawezi kuridhika wakati huo huo madhubuti kabisa; wao ni hiari. Hii ina maana kwamba hali ya "kukariri" haiwezi kuwa kamili; tunaweza tu kuzungumza juu ya kukariri na uwezekano fulani kwa muda fulani (sio mkubwa sana). Kwa maneno mengine, mfumo wa habari hauwezi kukumbuka milele. Katika mifumo halisi ya habari, wakati wa uhifadhi wa tabia hutegemea muundo wao, hali ya joto na nishati ya bure.

Swali la uhusiano kati ya entropy na habari katika nuru ya hapo juu inageuka kuwa sio ndogo. Entropy ya kimwili ni logarithm ya kiasi cha awamu kinachopatikana kwa mfumo (kwa kuzingatia kanuni za dhana hii - tazama hapo juu), iliyopimwa katika vitengo ambapo ni idadi ya digrii za uhuru na ukubwa wa kiini cha chini (quantum) nafasi ya awamu. Rasmi, entropy inaweza kuwakilishwa kama

Kiasi ni entropy kipimo katika bits; idadi ya seli za nafasi ya awamu. Kwa upande mwingine, uwezo wa habari unaweza kuandikwa katika fomu

iko wapi saizi ya nafasi ya awamu ya seli moja ya habari. Ulinganisho wa fomula (12.11) na (12.12) unaonyesha kwamba entropy na maelezo hutofautiana katika mgawo na ukubwa wa seli.

Sadfa ya (12.11) na (12.12) katika fomu ilitumika kama msingi wa taarifa kuhusu utambulisho wa dhana ya habari na entropy. Kwa usahihi zaidi, inaelezwa kuwa entropy ni habari inayokosekana kuhusu hali ya mfumo na (au) habari ni entropy inayokosekana, i.e. tofauti kati ya kiwango cha juu cha entropy, ambacho

ingekuwa na mfumo bila habari, na entropy halisi ambayo mfumo unayo, inayo habari iliyopokelewa. Katika suala hili, neno neentropy hutumiwa, ambayo inachukuliwa kuwa sawa na habari.

Wengi, hata hivyo, hawajaridhika na taarifa hizi na suala la uhusiano kati ya habari na entropy bado ni utata.

Hebu tujadili suala hilo kwa undani zaidi.

Kwanza kabisa, tofauti kubwa ya kiasi kati ya habari iliyomo kwenye mfumo na entropy yake ni ya kushangaza.

Blumenfeld (ona [P61) kwa kutumia idadi ya mifano ya kibiolojia (seli, viumbe, n.k.) ilionyesha kuwa entropi iliyo katika kitu ni mara nyingi (maagizo kadhaa ya ukubwa) zaidi ya taarifa inayopatikana ndani yake. Tofauti ni kubwa zaidi katika mifumo ya kisasa ya habari isiyo hai (kwa mfano, katika maandishi yaliyochapishwa, entropy inazidi habari kwa karibu mara 1010).

Tofauti kubwa kama hiyo ya kiasi sio bahati mbaya. Ni kutokana na ukweli kwamba kiasi cha nafasi ya awamu ya seli ya habari ni kubwa ikilinganishwa na thamani ya Mwisho ni kutokana na ukweli kwamba kiini cha habari lazima kiwe na mfumo mdogo wa ergodic na, kwa hiyo, kuchukua kubwa (ikilinganishwa na kiini cha msingi) kiasi.

Kwa hivyo, tofauti katika mizani ya entropy na habari sio bahati mbaya, lakini inahusishwa na tofauti zao za kimsingi. Entropy ni kipimo cha seti ya majimbo hayo ya mfumo ambayo mfumo unapaswa kusahau kuwa ndani; habari ni kipimo cha seti ya majimbo ambayo mfumo lazima ukumbuke kuwa ndani.

Hebu tuone jinsi mabadiliko katika entropy na maelezo yanahusiana kwa kutumia mfano wa billiards za Kichina. Wacha tuweke kikomo uzingatiaji wetu kwa maisha ya mfumo. Ukweli ni kwamba mfumo wowote wa habari, bila usawa, hupumzika na kuanguka kulingana na digrii zake za kimuundo za uhuru, i.e., huacha kuwa habari.

Muda wa kupumzika wa muundo ni mkubwa (au sawa) na wakati wa kukariri. Katika mfano wetu tunazungumza juu ya uharibifu wa hiari wa vizuizi kati ya mashimo; Wakati wa tabia ya mchakato huu ni mrefu sana. Wakati huu, digrii za kimuundo za uhuru hazibadilika, na kwa hiyo hazichangia entropy. (Sehemu ya nafasi ya awamu inayohusishwa na digrii hizi za uhuru haipatikani kwa wakati huu.) Entropy katika kesi hii inahusishwa tu na digrii za uhuru ambazo hupumzika haraka. Tabia yao haitegemei ni shimo gani mpira uko ndani na ikiwa umewekwa kwenye shimo lolote au iko karibu. Entropy ya kimwili ya mfumo ni sawa katika matukio yote, lakini kiasi cha habari ni tofauti: ni sawa na sifuri ikiwa mpira hauwekwa kwenye shimo, na sawa ikiwa ni kwenye shimo fulani.

Mchakato wa mapokezi ya habari (kwa upande wetu, kuweka mpira kwenye shimo fulani) inahitaji matumizi ya kazi, ambayo hugeuka kuwa joto (vinginevyo mapokezi hayawezi kurekebishwa). Kwa hiyo, juu ya mapokezi, entropy ya kimwili ya mfumo huongezeka (kwa kiasi na wakati huo huo

habari huongezeka (kwa kiasi Kawaida, lakini vinginevyo haziunganishwa kwa njia yoyote. Hivyo, wakati wa kupokea habari, uwiano hauzingatiwi.

Hali ni ngumu zaidi wakati habari mpya inapotokea. Mfumo unaoweza kuzalisha habari lazima uwe na mali yote ya mfumo wa habari na, kwa kuongeza, kukidhi hali: safu fulani ya nafasi ya awamu yake lazima iwe ya spherical, ikiwa ni pamoja na digrii za uhuru zilizochaguliwa (za habari). Ni katika kesi hii kwamba masharti ya awali yanawekwa kwa kuibuka kwa habari kwa hiari.

Mfano ni billiard sawa ya Kichina yenye pini. Ikiwa mara ya kwanza nishati ya kinetic ya mpira ni ya juu ya kutosha (vizuizi zaidi kati ya mashimo), basi mpira unasonga kwenye ubao mzima bila kukwama kwenye mashimo. Kutokana na kutokuwa na utulivu wa kutafakari kutoka kwa nywele za nywele (wanacheza nafasi ya nyuso za concave katika billiard ya Sinai, Mchoro 12.2), harakati ya mpira ni stochastic na hali ya awali ni haraka kusahau. Wakati nishati ya kinetic inapungua (kwa sababu ya kutokuwepo kwa mfumo, katika kesi hii kutokana na msuguano na migongano) kwa thamani kwa utaratibu wa urefu wa kizuizi, mpira huingia kwenye eneo la kuvutia la moja ya shimo na kubaki. ndani yake. Kwa hivyo, hali iliyochaguliwa "inakumbukwa," ambayo ni kuzaliwa kwa habari. Kanuni hiyo hiyo hutumiwa katika roulette na mashine nyingine za michezo ya kubahatisha.

Katika matukio haya yote, kigezo cha kutenganisha safu ya ergodic ya hali ya awali kutoka kwa safu ya habari ni thamani ya nishati ya awali ya bure (katika billiards hii ni nishati ya kinetic ya mpira). Pia huamua kuongezeka kwa entropy ya mfumo katika mchakato wa uzalishaji wa habari. Hebu tuhesabu thamani Ikiwa uwezo wa habari wa mfumo ni mdogo: basi kizuizi kikuu kutoka chini ni hali ambapo ni kizuizi kati ya visima. Vikwazo huamua wakati wa "kukariri" kulingana na uwiano

Kwa thamani kubwa ya kutosha (macroscopic) c, kizuizi ni

Kwa hivyo, katika kesi hii, ongezeko la entropy kwa kila habari ni sawa na

au katika vitengo vya habari:

Katika kesi wakati uwezo wa habari ni mkubwa (yaani, hali nyingine lazima izingatiwe: kabla ya hali fulani "kuchaguliwa," mfumo lazima utembelee angalau mara moja eneo la ushawishi wa kila moja ya majimbo iwezekanavyo.

Acha nishati ipotee wakati wa kupita kwa kila moja ya majimbo. Thamani ya chini ni juu ya mpangilio wa nishati ya kushuka kwa joto: Katika kesi hii, ni mdogo kutoka chini na hali.

Kuongezeka kwa entropy kwa kila sehemu ya habari ni sawa na

Kwa hivyo, katika tukio ambalo habari itatokea, mtu lazima "alipe" kwa kuongezeka kwa entropy, kwamba hata hivyo, mahusiano kama "kuongezeka kwa habari ni sawa na kupungua kwa entropy" haishiki katika kesi hii pia.

Wacha tujadili hali inayotokea ikiwa unakataa hali ya kukumbuka habari. Katika kesi hii, tunaweza kuzungumza juu ya habari juu ya maadili ya papo hapo ya kuratibu na wakati wa atomi zote za mfumo. Ili kutofautisha "habari" hii na ya kweli (iliyokariri), Laizer alipendekeza neno habari ndogo; habari iliyokaririwa inaitwa habari nyingi.

Ikiwa inajulikana kuwa kwa sasa mfumo uko katika seli moja (ya iwezekanavyo) maalum ya nafasi ya awamu, basi kiasi cha habari ndogo ni kubwa na sawa na

![]()

Katika kesi hii, entropy ya mfumo ni sifuri, kwani seli zingine zote zinaweza kuzingatiwa "hazipatikani" kwa sasa.

Ikiwa inajulikana kuwa kwa sasa mfumo uko katika seli yoyote inayowezekana, lakini haijulikani ni ipi, basi habari ndogo ni sifuri, na entropy ni ya juu na sawa na.

Ikiwa inajulikana kuwa mfumo kwa sasa uko katika moja (yoyote) ya seli, basi

na kati ya habari ndogo na entropy kuna uhusiano rahisi:

Habari ndogo, kimsingi, inaweza kubadilishwa kuwa habari kubwa kwa kuipokea na mfumo mwingine wa habari. Kwa mfano, kwa kupiga picha muundo wa mwendo wa Brownian, viwianishi vya papo hapo vya chembe vinaweza kunaswa (kukariri) kwenye filamu ya picha. Habari hii basi inaweza kutumika kwa yoyote (hata haihusiani na mwendo wa chembe)

malengo. Ni muhimu kwamba katika kesi hii, katika mchakato wa mapokezi (mabadiliko ya habari ndogo katika habari ya jumla), kazi lazima itumike na entropy ya mfumo mzima lazima iongezwe kwa kiasi ambacho ni wazi kuzidi kiasi cha habari iliyohifadhiwa.

Ni mchakato huu - ugeuzaji wa habari ndogo ndogo kuwa habari kubwa na matumizi yake kwa usimamizi - ndio msingi wa kitendawili cha "pepo wa Maxwell". Azimio lake ni kwamba mchakato wa kupokea taarifa ndogo na kuitumia kwa udhibiti unaambatana na ongezeko la entropy ya mfumo mzima / habari zaidi.

Kuhusiana na tofauti kubwa kama hiyo kati ya habari ndogo na kubwa, dhana mbili za entropy pia hutumiwa. Pamoja na entropy ya kimwili, entropy ya habari hutumiwa, ambayo inaelezwa kama

![]()

iko wapi idadi ya macrostates thabiti ambayo inajulikana kuwa mfumo uko katika moja yao (lakini haijulikani ni ipi).

Kulingana na ufafanuzi, entropy ya habari inahusiana na habari na uhusiano

Kuongezeka kwa habari (wakati kuhifadhiwa daima kunaambatana na kupungua sawa kwa entropy ya habari. Neno entropy ya habari ni rahisi kutumia wakati wa kuzungumza juu ya kuibuka kwa habari na utaratibu wa mfumo. Ni kwa maana hii kwamba hutumiwa. katika Sura ya 2. Tunasisitiza kwamba kwa entropy kimwili kiasi hiki, kwa ujumla, si kuhusiana.

Kwa hivyo, msingi wa tofauti kati ya entropy ya mwili na habari (kwa ubora na kiasi) ni hali ya uhifadhi na kiasi kikubwa cha nafasi ya awamu ya seli ya habari ikilinganishwa na ya msingi.

Inapendeza kukadiria saizi ya "hifadhi". Sasa ni vigumu kufanya hivyo kwa ujumla. Mtu anaweza kufikiria, hata hivyo, kwamba katika maumbile hai saizi bora imepatikana (hiyo ni ndogo, lakini inakidhi mahitaji). Inaweza kutathminiwa kwa kutumia data halisi.

Katika molekuli ya DNA, kitengo kilicho na biti mbili za habari ni jozi ya nyukleotidi za ziada. Ina kuhusu atomi. Entropy inayohusishwa na digrii za vibrational za uhuru ni kidogo, au entropy kwa bits ya habari ni takriban biti 60. Kwa hivyo kiasi cha nafasi ya awamu kwa biti ni sawa na

Dhana Entropy

kwa mara ya kwanza ilianzishwa mwaka wa 1865 na R. Clausius katika thermodynamics ili kuamua kipimo cha uharibifu wa nishati usioweza kurekebishwa. Entropy hutumiwa katika matawi mbalimbali ya sayansi, ikiwa ni pamoja na katika nadharia ya habari, kama kipimo cha kutokuwa na uhakika wa uzoefu wowote, mtihani, ambao unaweza kuwa na matokeo tofauti. Ufafanuzi huu wa entropy una muunganisho wa ndani wa ndani. Kwa hivyo, kwa msingi wa maoni juu ya habari, vifungu vyote muhimu zaidi vya fizikia ya takwimu vinaweza kutolewa. [BES. Fizikia. M: Encyclopedia kubwa ya Kirusi, 1998].

Kiasi hiki pia huitwa entropy wastani ujumbe. Entropy katika fomula ya Shannon ni sifa ya wastani - matarajio ya hisabati ya usambazaji wa kigezo cha nasibu.

Kwa mfano, katika mlolongo wa herufi zinazounda sentensi kwa Kirusi, herufi tofauti huonekana na masafa tofauti, kwa hivyo kutokuwa na uhakika wa kutokea kwa herufi zingine ni kidogo kuliko kwa zingine.

Mnamo 1948, akichunguza shida ya upitishaji wa habari wa busara kupitia chaneli ya mawasiliano yenye kelele, Claude Shannon alipendekeza mbinu ya kimapinduzi ya uelewa wa mawasiliano na kuunda nadharia ya kwanza ya kihesabu ya entropy. Mawazo yake ya kuvutia yalitumika haraka kama msingi wa ukuzaji wa nadharia ya habari, ambayo hutumia wazo la uwezekano. Wazo la entropy kama kipimo cha bahati nasibu lilianzishwa na Shannon katika nakala yake "Nadharia ya Kihisabati ya Mawasiliano", iliyochapishwa katika sehemu mbili katika Jarida la Kiufundi la Bell System mnamo 1948.

Katika kesi ya matukio yanayowezekana kwa usawa (kesi maalum), wakati chaguzi zote zinawezekana kwa usawa, utegemezi unabaki tu kwa idadi ya chaguzi zinazozingatiwa na formula ya Shannon imerahisishwa sana na inaambatana na formula ya Hartley, ambayo ilipendekezwa kwanza na mhandisi wa Amerika. Ralph Hartley mnamo 1928, kama moja ya njia za kisayansi za kutathmini ujumbe:

, ambapo mimi ni kiasi cha habari inayopitishwa, p ni uwezekano wa tukio, N ni idadi inayowezekana ya ujumbe tofauti (unaowezekana kwa usawa).Kazi ya 1. Kwa matukio yanayowezekana sawa.

Kuna kadi 36 kwenye sitaha. Ni habari ngapi iliyomo katika ujumbe kwamba kadi iliyo na picha ya "ace" ilichukuliwa kutoka kwa staha; "ace ya jembe"?

Uwezekano p1 = 4/36 = 1/9 na p2 = 1/36. Kwa kutumia formula ya Hartley tunayo:

Jibu: 3.17; 5.17 kidogo

Kumbuka (kutoka kwa matokeo ya pili) kwamba ili kusimba kadi zote, bits 6 zinahitajika.

Pia ni wazi kutokana na matokeo kwamba kadri uwezekano wa tukio unavyopungua, ndivyo habari zaidi inavyokuwa nazo. (Mali hii inaitwa monotoni)

Kazi ya 2. Kwa matukio yasiyowezekana

Kuna kadi 36 kwenye sitaha. Kati ya hizi, 12 ni kadi zilizo na "picha". Moja kwa moja, moja ya kadi huchukuliwa kutoka kwenye sitaha na kuonyeshwa ili kubaini ikiwa inaonyesha picha. Kadi inarudishwa kwenye staha. Amua kiasi cha habari inayotumwa kila wakati kadi moja inaonyeshwa.

Kiasi cha habari

Utangulizi

2. Kutokuwa na uhakika, kiasi cha habari na entropy

3. Fomula ya Shannon

4. Fomula ya Hartley

5. Kiasi cha taarifa zilizopokelewa wakati wa mchakato wa mawasiliano

Orodha ya fasihi iliyotumika

Utangulizi

Kulingana na ufafanuzi wa A.D. Ursula - "habari inaonyeshwa utofauti." Kiasi cha habari ni kipimo cha kiasi cha utofauti. Hii inaweza kuwa utofauti wa yaliyomo kwenye kumbukumbu; utofauti wa ishara inayotambulika wakati wa ujumbe fulani; matokeo mbalimbali ya hali fulani; utofauti wa vipengele vya mfumo fulani... ni tathmini ya uanuwai katika maana pana ya neno.

Ujumbe wowote kati ya chanzo na mpokeaji wa habari una muda fulani kwa wakati, lakini kiasi cha habari kinachotambuliwa na mpokeaji kama matokeo ya ujumbe hatimaye huonyeshwa sio kwa urefu wa ujumbe, lakini na anuwai ya ishara inayotolewa. katika mpokeaji kwa ujumbe huu.

Kumbukumbu ya carrier wa habari ina uwezo fulani wa kimwili ambayo ina uwezo wa kukusanya picha, na kiasi cha habari kilichokusanywa katika kumbukumbu hatimaye kinajulikana na utofauti wa kujaza uwezo huu. Kwa vitu visivyo na uhai huu ndio utofauti wa historia yao; kwa viumbe hai huu ndio utofauti wa uzoefu wao.

Tofauti ni muhimu wakati wa kuwasilisha habari. Hauwezi kupaka rangi nyeupe kwenye nyeupe; hali pekee haitoshi. Ikiwa kiini cha kumbukumbu kinaweza kuwa katika hali moja tu (ya awali) na haiwezi kubadilisha hali yake chini ya ushawishi wa nje, hii ina maana kwamba haina uwezo wa kutambua na kukumbuka habari. Uwezo wa habari wa seli kama hiyo ni 0.

Utofauti mdogo unahakikishwa na uwepo wa majimbo mawili. Ikiwa kiini cha kumbukumbu kinaweza, kulingana na ushawishi wa nje, kuchukua moja ya majimbo mawili, ambayo kwa kawaida huteuliwa "0" na "1", ina uwezo mdogo wa habari.

Uwezo wa habari wa seli moja ya kumbukumbu, yenye uwezo wa kuwa katika hali mbili tofauti, inachukuliwa kama kitengo cha kipimo kwa kiasi cha habari - 1 kidogo.

Biti 1 (bit - fupi kwa tarakimu ya binary ya Kiingereza - nambari ya binary) ni kitengo cha kipimo cha uwezo wa habari na kiasi cha habari, pamoja na thamani nyingine - entropy ya habari, ambayo tutajua baadaye. Bit, mojawapo ya vitengo vya kipimo visivyo na masharti. Ikiwa kitengo cha kipimo cha urefu kinaweza kuwekwa kiholela: dhiraa, mguu, mita, basi kitengo cha kipimo cha habari hakiwezi kuwa kingine chochote.

Katika kiwango cha kimwili, kidogo ni kiini cha kumbukumbu ambacho wakati wowote ni katika mojawapo ya majimbo mawili: "0" au "1".

Ikiwa kila pikseli ya picha inaweza tu kuwa nyeusi au nyeupe, picha kama hiyo inaitwa bitmap, kwa sababu kila pikseli inawakilisha seli ya kumbukumbu yenye ujazo wa biti 1. Balbu ya mwanga ambayo inaweza "kuwashwa" au "kuzimwa" pia inaashiria mdundo. Mfano mzuri unaoonyesha habari 1 ni kiasi cha habari iliyopatikana kama matokeo ya kurusha sarafu - "vichwa" au "mikia".

Kiasi cha taarifa sawa na biti 1 kinaweza kupatikana kwa kujibu swali la "ndiyo"/"hapana". Ikiwa mwanzoni kulikuwa na chaguo zaidi ya mbili za jibu, kiasi cha habari kilichopokelewa katika jibu fulani kitakuwa zaidi ya 1 kidogo, ikiwa kuna chaguo chini ya mbili za jibu, i.e. moja, basi hii sio swali, lakini taarifa, kwa hiyo, kupata habari haihitajiki, kwa kuwa hakuna uhakika.

Uwezo wa taarifa wa seli ya kumbukumbu inayoweza kupokea taarifa haiwezi kuwa chini ya biti 1, lakini kiasi cha taarifa iliyopokelewa inaweza kuwa chini ya 1 kidogo. Hii hutokea wakati chaguzi za jibu "ndiyo" na "hapana" hazipatikani kwa usawa. Ukosefu wa usawa, kwa upande wake, ni matokeo ya ukweli kwamba baadhi ya taarifa za awali (a priori) juu ya suala hili tayari zinapatikana, zilizopatikana, kwa mfano, kwa misingi ya uzoefu wa maisha ya awali. Kwa hivyo, katika hoja zote za aya iliyotangulia, tahadhari moja muhimu sana inapaswa kuzingatiwa: ni halali tu kwa kesi inayowezekana sawa.

Tutaashiria kiasi cha habari kwa ishara I, uwezekano unaonyeshwa na ishara P. Kumbuka kwamba uwezekano wa jumla wa kikundi kamili cha matukio ni sawa na 1.

2.Kutokuwa na uhakika, kiasi cha habari na entropy

Mwanzilishi wa nadharia ya habari, Claude Shannon, alifafanua habari kama kuondolewa kwa kutokuwa na uhakika. Kwa usahihi, kupata habari ni hali muhimu ya kuondoa kutokuwa na uhakika. Kutokuwa na uhakika hutokea katika hali ya uchaguzi. Kazi ambayo inatatuliwa wakati wa kuondoa kutokuwa na uhakika ni kupunguza idadi ya chaguzi zinazozingatiwa (kupunguza utofauti), na hatimaye kuchagua chaguo moja linalofaa kwa hali hiyo kutoka kwa wale wanaowezekana. Kuondoa kutokuwa na uhakika hufanya iwezekane kufanya maamuzi sahihi na kuchukua hatua. Hili ni jukumu la udhibiti wa habari.

Hali ya kutokuwa na uhakika wa kiwango cha juu hupendekeza kuwepo kwa mbadala kadhaa zinazowezekana kwa usawa (chaguo), i.e. wala chaguo ni vyema. Zaidi ya hayo, chaguzi zinazowezekana zaidi zinazingatiwa, kutokuwa na uhakika zaidi, ni vigumu zaidi kufanya uchaguzi usio na utata na habari zaidi inahitajika ili kupata hili. Kwa chaguo za N, hali hii inaelezewa na usambazaji wa uwezekano ufuatao: (1/N, 1/N, … 1/N).

Kutokuwa na uhakika wa chini ni 0, i.e. hii ni hali ya uhakika kabisa, ikimaanisha kwamba uchaguzi umefanywa na taarifa zote muhimu zimepokelewa. Usambazaji wa uwezekano wa hali ya uhakika kamili unaonekana kama hii: (1, 0, ...0).

Kiasi kinachoashiria kiasi cha kutokuwa na uhakika katika nadharia ya habari kinaonyeshwa na ishara H na inaitwa entropy, kwa usahihi zaidi entropy ya habari.

Entropy (H) ni kipimo cha kutokuwa na uhakika kinachoonyeshwa kwa biti. Entropy pia inaweza kuzingatiwa kama kipimo cha usawa wa usambazaji wa kibadilishaji nasibu.

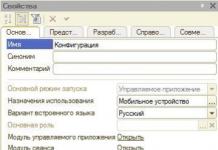

Mchele. 1. Tabia ya entropy

kwa kesi ya njia mbili mbadala.

Kielelezo 1 kinaonyesha tabia ya entropy kwa kesi ya mbadala mbili, wakati uwiano wa uwezekano wao unabadilika (p, (1-p)).

Entropy hufikia thamani yake ya juu katika kesi hii wakati uwezekano wote ni sawa kwa kila mmoja na sawa?, Thamani ya entropy ya sifuri inalingana na kesi (p0=0, p1=1) na (p0=1, p1=0).

Mchele. 2. Uhusiano kati ya entropy na kiasi cha habari.

Kiasi cha habari I na entropy H huonyesha hali sawa, lakini kutoka pande tofauti za ubora. Mimi ni kiasi cha habari kinachohitajika ili kuondoa kutokuwa na uhakika H. Kulingana na ufafanuzi wa Leon Brillouin, maelezo ni entropy hasi (negentropy).

Wakati kutokuwa na uhakika kunapoondolewa kabisa, kiasi cha taarifa nilichopokea ni sawa na kutokuwa na uhakika kulipo awali H.

Kutokuwa na uhakika kukiondolewa kwa kiasi, kiasi cha taarifa iliyopokelewa na kutokuwa na hakika iliyobaki ambayo bado haijatatuliwa huongeza juu ya kutokuwa na uhakika wa asili. Ht + It = H.

Kwa sababu hii, fomula ambazo zitawasilishwa hapa chini kwa kuhesabu entropy H pia ni fomula za kuhesabu kiasi cha habari I, i.e. tunapozungumza juu ya uondoaji kamili wa kutokuwa na uhakika, H ndani yao inaweza kubadilishwa na I.

3.Mchoro wa Shannon

Katika hali ya jumla, entropy H na kiasi cha habari nilichopata kama matokeo ya kuondoa kutokuwa na uhakika hutegemea idadi ya awali ya chaguzi zinazozingatiwa N na uwezekano wa kipaumbele wa utekelezaji wa kila moja yao P: (p0, p1, …pN-1), i.e. H=F(N, P). Entropy imehesabiwa katika kesi hii kwa kutumia formula ya Shannon, iliyopendekezwa naye mwaka wa 1948 katika makala "Nadharia ya Hisabati ya Mawasiliano".

Katika kesi maalum, wakati chaguzi zote zinawezekana kwa usawa, utegemezi unabaki tu kwa idadi ya chaguzi zinazozingatiwa, i.e. H=F(N). Katika kesi hiyo, formula ya Shannon imerahisishwa kwa kiasi kikubwa na inafanana na formula ya Hartley, ambayo ilipendekezwa kwanza na mhandisi wa Marekani Ralph Hartley mwaka wa 1928, i.e. Miaka 20 mapema.

Fomula ya Shannon ni kama ifuatavyo.

Mchele. 3. Kupata logariti ya b hadi base a ni kutafuta nguvu ambayo unahitaji kuongeza a ili kupata b.

Hebu tukumbushe logarithm ni nini.

Logarithm ya msingi 2 inaitwa binary:

log2(8)=3 => 23=8

log2(10)=3.32 => 23.32=10

Logariti hadi msingi 10 inaitwa decimal:

log10(100)=2 => 102=100

Tabia kuu za logarithm:

1. logi(1)=0, kwa sababu nambari yoyote kwa nguvu ya sifuri inatoa 1;

2. logi(ab)=b*logi(a);

3. logi(a*b)=logi(a)+logi(b);

4. logi(a/b)=logi(a)-logi(b);

5. logi(1/b)=0-logi(b)=-logi(b).

Alama ya kuondoa katika fomula (1) haimaanishi kuwa entropy ni thamani hasi. Hii inafafanuliwa na ukweli kwamba pi1 ni kwa ufafanuzi, na logarithm ya nambari chini ya moja ni thamani hasi. Kwa sifa ya logarithm, kwa hivyo fomula hii inaweza kuandikwa katika toleo la pili, bila minus kabla ya ishara ya jumla.

inafasiriwa kama kiasi fulani cha habari iliyopatikana katika kesi ya utekelezaji wa chaguo la i-th. Entropy katika fomula ya Shannon ni sifa ya wastani - matarajio ya hisabati ya usambazaji wa kigezo cha nasibu (I0, I1, ... IN-1).

Mfano wa kuhesabu entropy kwa kutumia fomula ya Shannon. Wacha muundo wa wafanyikazi katika taasisi fulani usambazwe kama ifuatavyo: - wanawake,? - wanaume. Kisha kutokuwa na uhakika kuhusu, kwa mfano, ni nani utakayekutana naye kwanza wakati wa kuingia kwenye taasisi, itahesabiwa na mfululizo wa vitendo vilivyoonyeshwa kwenye Jedwali 1.

Jedwali 1.

Ii=logi2(1/pi), biti

pi*logi2(1/pi), biti

Ikiwa inajulikana priori kuwa kuna idadi sawa ya wanaume na wanawake katika taasisi (chaguzi mbili zinazowezekana kwa usawa), basi wakati wa kuhesabu kwa kutumia formula sawa tunapaswa kupata kutokuwa na uhakika wa 1 bit. Dhana hii imejaribiwa katika Jedwali 2.

Jedwali 2.

Ii=logi2(1/pi), biti

pi*logi2(1/pi), biti

4.Mchanganyiko wa Hartley

Fomula ya Hartley ni kisa maalum cha fomula ya Shannon kwa njia mbadala zinazowezekana kwa usawa.

Kubadilisha thamani yake (katika hali inayowezekana sawa na i) kuwa fomula (1) badala ya pi, tunapata:

Kwa hivyo, formula ya Hartley inaonekana rahisi sana:

Inafuata wazi kutoka kwa hii kwamba kadiri idadi ya mbadala (N) inavyoongezeka, ndivyo kutokuwa na uhakika (H). Idadi hizi zinahusiana katika fomula (2) sio kwa mstari, lakini kupitia logarithm ya binary. Logarithm hadi msingi 2 na inapunguza idadi ya chaguo kwa vitengo vya habari - bits.

Entropy itakuwa integer tu ikiwa N ni nguvu ya 2, i.e. ikiwa N ni ya safu mlalo: (1, 2, 4, 8, 16, 32, 64, 128, 256, 512, 1024, 2048...)

Mchele. 3. Entropy inategemea idadi ya chaguo zinazowezekana kwa usawa (mbadala sawa).

Ili kutatua matatizo ya kinyume, wakati kutokuwa na uhakika (H) au kiasi cha habari kilichopatikana kutokana na kuondolewa kwake (I) kinajulikana na ni muhimu kuamua ni njia ngapi zinazowezekana zinazolingana na kutokea kwa kutokuwa na uhakika huu, tumia kinyume. Njia ya Hartley, ambayo imechukuliwa kwa mujibu wa ufafanuzi wa logarithm na inaonekana rahisi zaidi:

Kwa mfano, ikiwa inajulikana kuwa kama matokeo ya kuamua kwamba Kolya Ivanov wa kupendeza kwetu anaishi kwenye ghorofa ya pili, vipande 3 vya habari vilipatikana, basi idadi ya sakafu ndani ya nyumba inaweza kuamua na formula (3) kama. N = 23 = 8 sakafu.

Ikiwa swali ni: "kuna sakafu 8 ndani ya nyumba, ni habari ngapi tulipokea tulipojifunza kwamba Kolya Ivanov wa maslahi kwetu anaishi kwenye ghorofa ya pili?", Unahitaji kutumia formula (2): I = log2 (8) = biti 3.

5. Kiasi cha taarifa zilizopokelewa wakati wa mchakato wa mawasiliano

Hadi sasa, fomula zimetolewa kwa ajili ya kuhesabu entropy (kutokuwa na uhakika) H, ikionyesha kuwa H ndani yao inaweza kubadilishwa na mimi, kwa sababu kiasi cha habari kilichopatikana wakati kutokuwa na uhakika wa hali fulani ni kuondolewa kabisa ni kiasi sawa na entropy ya awali. ya hali hii.

Lakini kutokuwa na uhakika kunaweza kuondolewa kwa sehemu tu, kwa hivyo kiasi cha habari nilichopata kutoka kwa ujumbe fulani huhesabiwa kama kupungua kwa entropy ambayo ilitokea kama matokeo ya kupokea ujumbe huu.

Kwa kesi inayowezekana sawa, kwa kutumia fomula ya Hartley kukokotoa entropy, tunapata:

Usawa wa pili unatokana na sifa za logarithm. Kwa hivyo, katika kesi inayowezekana, ninategemea mara ngapi idadi ya chaguo zinazozingatiwa (anuwai inayozingatiwa) imebadilika.

Kulingana na (5) yafuatayo yanaweza kuamuliwa:

Ikiwa, basi - uondoaji kamili wa kutokuwa na uhakika, kiasi cha habari kilichopokelewa katika ujumbe ni sawa na kutokuwa na uhakika uliokuwepo kabla ya kupokea ujumbe.

Ikiwa, basi - kutokuwa na uhakika haujabadilika, kwa hiyo, hakuna taarifa iliyopokelewa.

Ikiwa, basi => , ikiwa, => . Wale. kiasi cha habari iliyopokelewa itakuwa thamani nzuri ikiwa, kutokana na kupokea ujumbe, idadi ya njia mbadala zinazozingatiwa imepungua, na hasi ikiwa imeongezeka.

Ikiwa idadi ya njia mbadala zinazozingatiwa kama matokeo ya kupokea ujumbe ni nusu, i.e. , kisha I=log2(2)=1 kidogo. Kwa maneno mengine, kupokea 1 kidogo ya habari huondoa nusu ya chaguo sawa kutoka kwa kuzingatia.

Fikiria, kama mfano, jaribio na staha ya kadi 36.

Mchele. 4. Mchoro wa majaribio na staha ya kadi 36.

Acha mtu achukue kadi moja kutoka kwenye staha. Tunavutiwa na ni kadi gani kati ya 36 alizochukua. Kutokuwa na uhakika kwa awali, kukokotolewa kwa kutumia fomula (2), ni H=logi2(36) biti 5.17. Anayechora kadi anatuambia habari fulani. Kwa kutumia fomula (5), tunabainisha ni taarifa ngapi tunazopokea kutoka kwa ujumbe huu:

Chaguo A: "Hii ni kadi nyekundu."

I=log2(36/18)=log2(2)=1 biti (kuna nusu kadi nyekundu kwenye sitaha, kutokuwa na uhakika kumepungua kwa mara 2).

Chaguo B: "Hii ni kadi ya suti ya jembe."

I=log2(36/9)=log2(4)=biti 2 (kadi za jembe hufanya robo ya sitaha, kutokuwa na uhakika kumepungua kwa mara 4).

Chaguo C. "Hii ni mojawapo ya kadi za juu: jack, malkia, mfalme au Ace."

I=log2(36)-log2(16)=5.17-4=1.17 bits (kutokuwa na uhakika kumepungua kwa zaidi ya nusu, hivyo kiasi kilichopokelewa cha taarifa ni zaidi ya biti moja).

Chaguo D. "Hii ni kadi moja kutoka kwenye sitaha."

I=log2(36/36)=log2(1)=0 biti (kutokuwa na uhakika haujapungua - ujumbe si wa taarifa).

Chaguo D. "Huyu ndiye malkia wa jembe."

I=log2(36/1)=log2(36)=5.17 biti (kutokuwa na uhakika kumeondolewa kabisa).