Многие владельцы сайтов уделяют внимание главным образом тому, чтобы контент был уникален по сравнению с другими ресурсами. Однако не стоит упускать из виду наличие дублированного контента в пределах одного сайта. Это тоже оказывает сильное влияние на ранжирование.

Что такое дублированный контент

Повторяющийся, или дублированный, контент – это совпадающие в рамках сайта объемные блоки текста на разных страницах. Не обязательно такое делается со злым умыслом – чаще возникает по техническим причинам, подробно разобранные ниже.

Опасность состоит в том, что часто дублированный контент невозможно увидеть невооруженным глазом, однако поисковик его прекрасно видит и реагирует соответствующим образом.

Откуда берется дублированный контент и где он чаще встречается

Основные причины возникновения такого явления:

- Изменение структуры сайта;

- Намеренное использование в конкретных целях (скажем, версии для печати);

- Ошибочные действия программистов и веб-мастеров;

- Неувязки с CMS.

Например, часто встречается ситуация: replytocom (ответ на комментарий) в WordPress автоматически формирует и новые страницы с разными URL-адресами, но не содержимым.

Обычно дублированный контент замечается при создании анонсов статьи на других страницах сайта, размещении отзывов, а также при одинаковых описаниях товаров, категорий, рубрик.

Почему дублированный контент – это плохо

У повторяющегося содержимого есть аналог из области экономики – банковский овердрафт. Только здесь расходуется так называемый краулинговый бюджет. Это число страниц ресурса, которое за конкретный промежуток времени сможет просканировать поисковая машина. Ресурс очень ценный, и лучше потратить его на действительно важные и актуальные страницы, чем на десятки дублей идентичного текста.

Таким образом, дублированный контент ухудшает поисковое продвижение. Кроме того, теряются естественные ссылки и неверно распределяется ссылочный вес внутри сайта. А также подменяются по-настоящему релевантные страницы.

Как найти дублированный контент на сайте (вручную, программы и сервисы)

Существуют специальные программы для анализа ресурсов. Из них пользователи особенно выделяют Netpeak Spider. Она ищет полные копии страниц, совпадения по тайтлу или дескрипшену, заголовкам. Другой вариант — Screaming Frog, которая обладает схожим функционалом и по сути отличается только интерфейсом. Еще есть приложение Xenu`s Link Sleuth, работающее схожим с поисковиком образом и способное довольно качественно прочесать сайт на наличие дубликатов.

К сожалению, нет инструментов, способных полноценно отслеживать все дубли текста. Поэтому, скорее всего, придется производить ручную проверку. Вот список возможных факторов, повлекших за собой проблему:

Разобрались, как найти дублированный контент. А лучшие помощники в борьбе с ним – это переадресация 301, теги Canonical URL, указания в robots.txt и параметры Nofollow и Noindex в составе мета-тега «robots».

Одним из способов на скорую руку проверить, если ли на сайте дублированный контент, является расширенный поиск в Яндексе или Гугле. Необходимо ввести адрес сайта и кусок текста со страницы, которую решили проверить. Также можно использовать многочисленные программы для проверки уникальности текста:

- Text.Ru;

- eTXT Антиплагиат;

- Advego Plagiatus;

- Content-Watch.

Как бороться и чистить дублированный контент

Всё та же справочная система Гугл дает ряд советов по предотвращению появления данной проблемы.

- 301. При структурных изменениях ресурса необходимо указывать редирект 301 в файле htaccess.

- Используйте единый стандарт ссылок.

- Контент для конкретного региона лучше размещать на доменах верхнего уровня, чем на поддоменах или в поддиректориях.

- Устанавливайте предпочтительный способ индексирования с помощью Search Console.

- Не используйте шаблоны. Вместо того, чтобы на каждой странице размещать текст о защите авторского права, лучше сделать ссылку, которая будет вести на отдельную страницу с этим текстом.

- Разрабатывая новые страницы, следите, чтобы до полной готовности они были закрыты от индексации.

- Разберитесь, как именно отображается ваш контент – могут быть отличия отображения в блогах и форумах.

- Если на сайте много схожих статей, лучше или объединить их содержимое в одно целое, или уникализировать каждую.

Поисковиками не предусмотрено никаких санкций по отношению к сайтам, имеющим дублированный контент по техническим причинам (в отличие от тех, кто делает это намеренно с целью манипулировать результатами поиска или вводить в заблуждение посетителей).

После того, как дубли удалены, осталось убрать их из поисковой выдачи. Яндекс делает это самостоятельно, при условии, что файл robots.txt настроен должным образом. Что касается Google: там придется вручную прописать правила в Вебмастере, на вкладке «Параметры URL».

Заключение

Борьба с дублированным контентом на сайте – важный аспект деятельности владельца любого сайта. Причин его возникновения довольно много, и столь же много способов устранения.

Однако главным правилом остается: размещать исключительно оригинальный контент, независимо от типа сайта. Даже если это крупный сетевой магазин с тысячами страниц.

ПОЛУЧАЙТЕ АНОНСЫ ПОДОБНЫХ ПОСТОВ СЕБЕ НА ПОЧТУ

Подпишитесь и получайте не чаще, чем раз в неделю что-нибудь интересное из мира интернет-маркетинга, SEO, продвижения сайтов, интернет-магазинов, заработка на сайтах.

» я уже касался темы дублированных страниц и сегодня поговорим об этом более подробно.

Что такое дубли страниц ? Это страницы с похожим или одинаковым текстом доступные по разным URL адресам. Например, очень часто встречающиеся дубли главной страницы ресурса

Ниже мы рассмотрим несколько распространенных вариантов дублирования контента, а сейчас давайте поговорим о том, как влияют похожие страницы на продвижение сайта.

Поисковые системы давно научились определять уникальность текста по последовательности символов, т.е по одинаково составленным предложениям, откуда берется последовательность букв и пробелов. Если контент не уникальный (ворованный), то робот без труда это выяснит, а когда не уникальный текст встречается часто, то перспектива попадания такого ресурса под фильтр АГС довольно высока.

Давайте представим себе работу поискового робота. Зайдя на сайт он в первую очередь смотрит на файл robots.txt и от него получает инструкции: что нужно индексировать и что для индексации закрыто. Следующим его действием будет обращение к файлу sitemap.xml, который покажет роботу карту сайта со всем разрешенными маршрутами. Почитайте статью — «Файл sitemap.xml для поисковиков Google и Яндекс .» Получив всю необходимую информацию, робот отправляется выполнять свои привычные функции.

Зайдя на определенную страницу он «впитывает» ее содержимое и сравнивает с уже имеющейся в его электронных мозгах информацией, собранной со всего бескрайнего простора интернета. Уличив текст в не уникальности поисковик не станет индексировать данную страницу и сделает пометку в своей записной книжке, в которую он заносит «провинившиеся» URL адреса. Как Вы наверное уже догадались на эту страницу он больше не вернется, дабы не тратить свое драгоценное время.

Допустим, страница имеет высокую уникальность и робот ее проиндексировал, но пройдя по следующему URL того же ресурса он попадает на страницу с полностью или частично похожим текстом. Как в такой ситуации поступит поисковик? Конечно он тоже не станет индексировать похожий тест, даже если оригинал находиться на том же сайте, но по другому URL. Робот наверняка останется недоволен бесполезно потраченным временем и обязательно сделает пометочку в своем блокноте. Опять же, если такой инцидент будет неоднократно повторяться, то ресурс может пасть в немилость к поисковой системе.

Вывод №1. Похожие страницы расположенные по разными URL отнимают время, которое отводится роботу для индексации сайта. Дубли страниц он все равно индексировать не будет, но потратит часть временного лимита на ознакомление с ними и возможно не успеет добраться до действительно уникального контента.

Вывод№ 2. Дублированный контент отрицательно скажется но продвижении сайта в поисковой системе. Не любят поисковики не уникальные тексты!

Вывод №3. Надо обязательно проверять свой проект на дубли страниц, чтобы избежать проблем перечисленных выше.

Многие совершенно не заботятся об «чистоте» своего контента. Ради интереса я проверил несколько сайтов и был несколько удивлен положению дел с дублями страниц. На блоге одной женщины я вообще не обнаружил файла robots.txt.

Необходимо со всей серьезность бороться с дублями контента и начинать надо с их выявления.

Примеры часто встречающихся дублей контента и способы устранение проблемы

Дубль главной страницы. Пример:

- http://сайт.com

- http://сайт.com/index.php.

В этом случаи вопрос решается с помощью 301 редиректа — «командой» для сервера через файл.htaccess.

Еще один пример дубля главной страницы:

- http://сайт.com

- http://www.сайт.com

Чтобы избежать подобного дублирования можно прописать основное зеркало сайта в файле robots.txt в директиве — «Host» для Яндекс:

- Host: сайт.com

А также воспользоваться 301 редиректом и указать поисковикам Яндекс и Google на главное зеркало сайта посредством инструментов для веб-мастеров.

Пример дубля главной страницы, который чуть не взорвал мне мозг при поиске решения выглядит так:

- http://сайт.com

- http://сайт.com/

Я где-то прочитал, что слеш в конце ссылки на главную страницу, создает дубль и поисковики воспринимают ссылки со слешом и без, как разные URL, ведущие на страницу с одинаковым текстом. Меня забеспокоила даже не сама возможность дублирования, сколько потеря веса главной страницы в такой ситуации.

Я начал копать. По запросу к серверу по вышеупомянутым URL я получил ответ код 200. Код 200 означает — » Запрос пользователя обработан успешно и ответ сервера содержит затребованные данные». Из этого следует, что все-таки дубль на лицо.

Я даже попытался сделать 301 редирект (перенаправление), но команды не действовали, и желанного ответного кода 301 я так и получил. Решение проблемы состояло в отсутствии самой проблемы. Каламбур такой получился. Оказывается, современные браузеры сами подставляют символ «/» в конце строки, делая его невидимым, что автоматически делает дубль невозможным. Вот так!

Ну и еще один пример дубля главной страницы:

- http://сайт.com

- https://сайт.com

Бывают случаи, что по ошибке веб-мастера или глюка поисковика или при других обстоятельствах в индекс попадает ссылка под защищенным протоколом https://. Что же делать в таком случаи и как избежать этого в будущем? Конечно надо удалить ссылки с протоколом https://из поиска, но делать придется в ручную средствами инструментов для веб-мастеров:

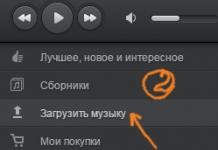

В поисковой системе Яндекс, веб- мастер — мои сайты — удалить URL:

Важно ! Директивы, прописанные в файле robots.txt, запрещают поисковым роботам сканировать текст, что уберегает сайт от дублей, но те же директивы не запрещают индексировать URL страниц.

Подробнее читайте в статьях:

Есть еще один довольно действенный способ определения «клонов» с помощью самих поисковых систем. В Яндексе в поле поиска надо вбить: link.сайт.com «Фрагмент теста». Пример:

Яндекс нашел 2 совпадения потому, что я не закрыл от индексации категории и поэтому есть совпадение с анонсом на главной странице. Но если для кулинарного блога участие рубрик в поиске оправдано, то для других тематик, таких как SEO такой необходимости нет и категории лучше закрыть от индексации.

С помощью поиска Google проверить можно так: site:сайт.com «Фрагмент текста». Пример:

Программы и онлайн сервисы для поиска внутренних и внешних дублей контента по фрагментам текста

Я не буду в этой статье делать подробный обзор популярных программ и сервисов, остановлюсь лишь на тех, которыми сам постоянно пользуюсь.

Для поиска внутренних и внешних дублей советую использовать онлайн сервис www.miratools.ru . Помимо проверки текста сервис включает еще различные интересные возможности.

Программа для поиска дублей — Advego Plagiatus . Очень популярная программа, лично я ей пользуюсь постоянно. Функционал программы простой, чтобы проверить текст достаточно скопировать его и вставить в окно программы и нажать на старт.

После проверки будет представлен отчет об уникальности проверяемого текста в процентах с ссылками на источники совпадений:

Также, будут выделены желтым фоном конкретные фрагменты текста, по которым программы нашла совпадения:

Очень хорошая программа, пользуйтесь и обязательно подпишитесь на обновления блога .

До встречи!

С уважением, Кириллов Виталий

1. Введение в проблему

В настоящее время все острее и острее встает проблема дублирования информации в интернете. Чаще всего такое дублирование совершается умышленно, с нарушением авторских прав. Злоумышленники используют авторский контент для наполнения собственных сайтов, чтобы извлекать для себя выгоду.

Такое дублирование информации ухудшает выдачу поисковых систем, вследствие чего последние активно борются с этим явлением. Действительно, если пользователь получает по запросу 10 одинаковых документов («одинаковость» определяется пользователем по ), это вряд ли добавляет популярности поисковику. Несколько лет назад такая ситуация наблюдалась в Рамблере, вследствие чего поисковик растерял часть своего рейтинга. Однако сейчас Rambler отфильтровывает и скрывает дубликаты.

Также нужно отметить, что дублирование контента засоряет индекс поисковика, ему становится труднее выдавать быстрые ответы пользователю. При этом все документы нужно регулярно индексировать, а появление новых документов с неоригинальным контентом явно вредит скорости индексации.

2. Теория по определению «нечетких дубликатов»

a. Что такое «нечеткий дубль»

Для начала нужно определиться с терминологией. Единого мнения по этому поводу в еще нет, и поэтому данная терминология отталкивается просто от здравого смысла.

Дубль (дубликат) web-документа – точная копия web-документа. «Нечеткий дубликат» web-документа – web-документ, частично измененный в содержательной части и/или в части форматирования (использование других тегов html для оформления страницы).

Мы будем трактовать «дубликат web-документа» только с точки зрения поисковой системы, а не пользователя. Поэтому мы не будем рассматривать такое явление как «копирайтинг», т.е. переписывание текста специально для поисковых систем с использованием других слов, но с сохранением общего смысла. Такой текст для поисковика будет всегда оригинальным, т.к. смысл текста компьютеры пока различать не могут.

Существует несколько основных методов определения дубликатов.

b. Метод «описательных слов»

Данный метод работает по следующему принципу.

Сначала формируется небольшая (ок. 2000-3000 слов) выборка. Выборка должна удовлетворять следующим условиям:

С ее помощью можно достаточно полно описать практически любой документ в сети

- описание документа не должно быть при этом избыточным

Таким образом, для формирования выборки нужно отбросить слова, которые наиболее и наименее употребительны, т.е. не учитывать стоп-слова и различные узко тематические термины. Также в выборку не попадают прилагательные, так как они не несут в русском языке смысловой нагрузки.

Далее каждый документ сопоставляется с выборкой и рассчитывается вектор, размерность которого равна количеству слов в выборке. Компоненты вектора могут принимать два значения – 0 или 1. 0 – если слова из выборки нет в документе, 1 – если слово встречается в документе. Далее документы проверяются на дублирование путем сопоставления их векторов.

По такому алгоритму Яндекс определяет нечеткие дубликаты.

c. Метод шинглов

Метод шинглов заключается в следующем. Для всех подцепочек анализируемого текста рассчитывается «контрольная сумма». Контрольная сумма (или "сигнатура") - это уникальное число, поставленное в соответствие некоторому тексту и/или функция его вычисления. Функция вычисления контрольных сумм может преследовать несколько целей: например "невзламываемость" (минимизируется вероятность того, что по значению контрольной суммы можно подобрать исходный текст) или "неповторяемость" (минимизируется вероятность того, что два разных текста могут иметь одну контрольную сумму) - Электронный журнал "Спамтест" No. 27.

Обычно используются следующие алгоритмы вычисления контрольных сумм: fnv, md5, crc. После вычисления контрольных сумм строится случайная выборка из полученного набора. По этой выборке документ можно сличать с другими документами, для которых также предварительно рассчитана выборка.

Данный метод расчета является достаточно ресурсоемким и его можно обойти, незначительно изменив текст, так как, прежде всего, шинглы зависят от расстояния между словами.

Сейчас метод шинглов эволюционировал до алгоритма «супершинглов», при котором стоится ограниченный набор контрольных сумм. Эксперименты на РОМИП привели к следующим результатам – 84 шингла, 6 супершинглов над 14 шинглами каждый. Тексты считаются совпавшими при совпадении хотя бы двух супершинглов из 6.

Официальными лицами неоднократно заявлялось, что Яндекс не рецензент и не будет бороться с проблемой воровства контента в сети .

Вот официальный ответ А. Садовского:

... поиск Яндекса при обнаружении дубликатов пытается определить оригинал документа. Существующие алгоритмы, конечно, несовершенны и мы работаем над их улучшением. Что касается юридического регулирования, поисковые системы пока не могут идентифицировать авторство текста. В случае удаления из сети «тыренного» контента (например, в результате действий правообладателя), Яндекс также удалит его из базы по мере обхода роботом. Этот процесс можно ускорить, воспользовавшись формой http://webmaster.yandex.ru/delurl.xml

Теперь рассмотрим, а что есть для Яндекса «дубликат документа»? Автор предлагает следующую трактовку. (Если ниже приведенный текст показался вам знакомым, то не думайте плохого, автор не так давно пытался активно обсуждать данную проблему на форумах)))

Существует два вида дубликатов: «нечеткие дубликаты» и «полные дубликаты».

«Нечеткие дубликаты» зависят от сниппета, т.е. определяются фактически запросом пользователя. Происходит это следующим образом.

1. Пользователь задает запрос.

2. Яндекс вычисляет релевантность сайтов запросу и ранжирует сайты, но пока еще не показывает пользователю.

3. Далее Яндекс сравнивает сниппеты отобранных документов на предмет определения дубликатов (возможно, сниппеты сравниваются методом шинглов).

4. И наконец, выдает отфильтрованную выдачу, удаляя некоторые дубликаты (по какому принципу оставляются те или иные документы – неясно; возможно, выбирается самый релевантный документ, и вместе с ним в выдачу попадают наименее похожие на него документы; возможно, играет роль только ссылочное окружение сайтов).

Существование фильтр такого типа косвенно доказывают слова Садовского (пост №9) и то, что выдача с различными настройками поиска (конкретно, количество отображаемых фрагментов со словами запроса) различная.

При настройках «отображать не более 5 фрагментов» в выдаче больше сайтов, чем при настройках «отображать не более 1 фрагмента». Попробуем запрос «Во & второй & главе & реферата & посвящена & практике & маркетинговой & деятельность & организации & на & примере & сервер & дукса» (запрос задается без кавычек!) - в первом случае (отображать 1 фрагмент в сниппете) в выдаче 21 сайт, во втором (5 фрагментов) – 27 сайтов.

Все здесь логично – при отображении одного пассажа в сниппете, сниппеты более похожи, чем когда отображается 5 пассажей в сниппете. Например, во втором случае у второго сайта сниппет отличается от сниппетов первого и третьего сайта.

Теперь разберемся с «полными дубликатами». Автор считает, что такие дубликаты определяются в момент индексации страницы. Это удобно, так как сразу позволяет отсечь мусор и не добавлять в базу данных поисковика дублированную информацию.

Метод определения дубликатов - «метод описательных слов» (о котором говорилось выше).

Страницы, выявленные как полные дубликаты – выкидываются из базы. Часто такое происходит со страницами одного сайта (например, каталог товаров, когда значимой информации гораздо меньше, чем слов в навигационной части). По какому принципу Яндекс выкидывает те или иные дубликаты – неизвестно, скорее всего, по совокупности признаков как то: временные факторы, «рейтинг ресурса», доверие к ресурсу и проч.

Как Яндекс определяет первоисточник в случае обнаружения «нечетких дублей» и определяет ли его? Давайте попробуем разобраться…

Сначала выделим факторы, которые могут указывать на первоисточник контента…

Дата создания документа

- релевантность документа запросу

- «доверие к ресурсу» (например, больше всего можно доверять ресурсам, имеющим хорошую позицию в Каталоге Яндекса, и высокую посещаемость)

- перелинковка между дубликатами (например, если все дубликаты ссылаются на один и тот же документ – он и есть первоисточник)

Попробуем осуществить небольшой эксперимент. Возьмем страницу href=http:// zoom.cnews.ru/ru/publication/index.php?art_id80=1523 и фразу "По дизайну Lumix FZ50 похожа на свою 8-мегапиксельную предшественницу FZ30". Явно это оригинал. Теперь посмотрим, кто еще использует текст статьи: зададим запрос с использованием параметра rd=0. Без rd в выдаче только сайт №1 и №5.

Характеристики сайтов следующие (заметим, что ссылаются только на первую страницу, у остальных бэклинков нет):

| Станица | тИЦ | Рубрика каталога | PR | PR стр-цы |

| zoom.cnews.ru/ru/publication/index.php?art_id80=1523 | 3800 | Да | 6 | 4 |

| www.neograd.ru/firsttimers/howtofind_1/panasonic/test_panasonic_fz50 | 170 | Да | 5 | 0 |

| www.apitcomp.ru/analytic/genre3/page637 | 700 | Да | 4 | 0 |

| www.toplist.ru/card/35859 | 110 | Нет | 3 | 0 |

| foto-focus.ru/forum/showthread.php?mode=hybrid&t=316 | 0 | Нет | 1 | 0 |

| nmp4.ru/index.php?act=Print&client=printer&f=223&t=3323 | 0 | Нет | 0 | 0 |

| www.media.nrd.ru/index.php?showtopic=3323&st=100 | 40 | Нет | 0 | 0 |

| www.ledshop.ru/cgi-bin/nph-proxy.cgi/010110A/http/zoom.cnews.ru/ru/publication/index.php=3fart_id80=3d1523 | 0 | Нет | 0 | 0 |

Заметим, что сниппеты у всех сайтов одинаковые.

На первый взгляд совершенно неясно, почему Яндекс отфильтровал все сайты кроме пятого. Сайт явно не является авторитетным в глазах Яндекса. Логичнее было бы оставить в выдаче страницу с сайта www.apitcomp.ru – сайт является более авторитетным или оставить страницы с форумов (позиция 6 и 7).

Аналогично проверим для страницы http://www.3dnews.ru/digital/lumix_fz50/ и фразы "В наше время, когда покупателей, жаждущих хороших характеристик". Жирным выделены сайты, которые показываются без rd=0, красным – первоисточник, который, кстати, фильтруется!

| Страница | тИЦ | YACA | LS | LP | PR | Page PR |

| saturn-plus.ru/ | 70 | Да | 54 | 20349 | 3 | 3 |

| saturn.24online.ru/ | 0 | Нет | 1 | 1 | 0 | 0 |

| www.3dnews.ru/digital/lumix_fz50/print | 11000 | Да | 0 | 0 | 6 | 2 |

| fotomag.com.ua/handbook14.html | 400 | Да | 0 | 0 | 4 | 0 |

| Deshevshe.net.ua/ua/review-73/4.html | 80 | Нет | 0 | 0 | 4 | 0 |

| Ephotolink.ru/?mod=articles&act=show&sort=date&page=9 | 1400 | Да | 0 | 0 | 4 | 1 |

| mobil-up.com/tsifra/foto/novoe_pokolenie_ultrazumov_ot_panasonic.html | 0 | Нет | 0 | 0 | 0 | 0 |

| uaport.net/UAit/?CGIQUERY=0&lang=RUS&cli=1&dtb=146&… | 4300 | Да | 0 | 0 | 6 | 0 |

| www.velc.ru/podderjka/stati/lumix_fz50/ | 120 | Да | 0 | 0 | 3 | 0 |

| Ephotolink.tkat.ru/?mod=articles&id_article=21007 | 10 | Нет | 0 | 0 | 3 | 0 |

| www.ru-coding.com/rss.php?p=501 | 130 | Да | 0 | 0 | 3 | 0 |

| www.toprunet.com/article.php?id=6388 | 200 | Нет | 0 | 0 | 3 | 0 |

| www.dphotographer.com.ua/camera/from/2/ | 90 | Нет | 0 | 0 | 4 | 0 |

| www.asmedia.ru/news/id8242.html | 400 | Нет | 0 | 0 | 3 | 0 |

| www.mega-bit.ru/obzor/read/?id=70 | 40 | Нет | 0 | 0 | 3 | 0 |

| www.audiovideophoto.ru/panasonic1.html | 0 | Нет | 0 | 0 | 0 | 0 |

| www.foto-piter.ru/news/2006/12/01/127/ | 10 | Нет | 0 | 0 | 2 | 0 |

| www.megastoke.ru/item951928/panasonic-lumix-dmc-fz50.html | 20 | Нет | 0 | 0 | 1 | 0 |

| www.novoe.nnov.ru/articles/?parent_id=33 | 0 | Нет | 0 | 0 | 0 | 0 |

| iwy.com.ua/top.php?p=326 | 0 | Нет | 0 | 0 | 0 | 0 |

| www.5-uglov.ru/articles_view.php?id_news=1222 | 90 | Да | 0 | 0 | 3 | 0 |

| www.techhome.ru/catalog/photo/article_17112.html | 950 | Да | 0 | 0 | 5 | 3 |

| www.panasonic-spb.ru/articles_view.php?id_news=1222 | 0 | Нет | 0 | 0 | 1 | 0 |

| new-articles.ru/page_215.html | 40 | Нет | 0 | 0 | 3 | 0 |

| www.ekvator-hifi.ru/articles_view.php?id_news=1222 | 10 | Нет | 0 | 0 | 1 | 0 |

| shop.key.ru/shop/goods/36608/ | 230 | Нет | 3 | 18 | 4 | 0 |

| www.pc-shop.kz/index.php?g_id=1711 | Нет | 0 | 0 | 3 | 0 | |

| Portalink.ru/portal/ecamera/infoat_15269.htm | 110 | Нет | 0 | 0 | 3 | 3 |

| www.rusdoc.ru/articles/13085/ | 1100 | Да | 3 | 13 | 5 | 1 |

| www.docs.com.ru/articles.php?p=509 | 220 | Нет | 0 | 0 | 4 | 0 |

| e-libed.ru/a31/ | 0 | Нет | 1 | 17 | 0 | 0 |

| dvdlink.ru/portal/Ecamera/infoat_15269.htm | 140 | Нет | 0 | 0 | 3 | 0 |

| www.articlesearch.ru/a3b856d85.html | 0 | Нет | 0 | 0 | 0 | 0 |

| www.bestarticles.ru/a31/ | 0 | Нет | 1 | 5 | 2 | 0 |

| www.temu.ru/a31/ | 0 | Нет | 0 | 0 | 2 | 0 |

LP – ссылающихся страниц, LS – ссылающихся сайтов, Page PR – PR страницы, PR – PR главной страницы сайта.

Аналогичная картина – критерии фильтрации совершено неясны. Однако, если посмотреть на сниппеты, то мы увидим, что у страниц на сайтах uaport.net, www.megastoke.ru , portalink.ru сниппеты несколько отличаются от сниппетов других сайтов и поэтому первый и третий сайт не фильтруется.

Что сказать в итоге? Прежде всего, конечно нужно еще много экспериментировать и анализировать, однако уже видно, что решение о фильтрации «нечетких дубликатов» основывается на анализе многих факторов, главным из которых является оригинальность сниппета.

4. Google и дублирование контента

Google стремится выдавать на запросы пользователя сайты только со свежим и уникальным контентом.

Google считает, что пользователи не хотят видеть дубликаты в результатах поиска, поэтому такие документы скрываются в suggestion results. Если пользователь все же захочет увидеть дубликаты (например, это веб-мастер, который хочет выяснить, кто ворует контент с его сайта), то он должен добавить параметр «&filter=0» в конец URL.

Google считает, что идентификация автора контента поможет улучшить поиск. Однако отмечает, что такие способы определения первоисточника как фиксация даты создания документа или регистрация контента авторами в специальных сервисах не эффективны. Пока Google ориентируется по большей части на авторитетность ресурса и количество входящих ссылок. Поэтому вполне возможна ситуация, когда какой-нибудь известный ресурс позаимствовал статью, например, у специализированного ресурса, далее большинство узнало о статье из известного ресурса и поставило на него ссылки; в итоге Google определит известный сайт как первоисточник…

В случае дублирования контента на одном сайте (например, страница-оригинал и страница для печати) Google предлагает веб-мастерам активно использовать robots.txt. Также предлагается отказаться от использования идентификаторов сессий, так как это тоже может привести к дублированию контента. Т.е. поисковик может проиндексировать одну и ту же страницу, но с разным url, отличающимся значением параметра sessid.

5. Над чем можно поэкспериментировать и как это лучше сделать

Итак, мы выяснили основные моменты по проблеме дублирования контента. Принципы работы фильтра (в частности Яндекса) достаточно просты, однако определить в точности, как учитываются различные факторы достаточно сложно.

Итого, что нужно проверить экспериментальным путем:

Как дубликаты фильтруются в момент выдачи? По какому принципу?

- Метод «описательных слов» - как формируется выборка слов и как сравниваются вектора?

- По какому принципу выкидываются «полные дубликаты»?

Можно предложить следующий вариант:

Создаем один сайт с оригинальным контентом. Немного спамим его, чтобы он проиндексировался. Создаем далее некоторое количество клонов (дубликатов). Клоны можно сделать различным образом: перемешать слова первоисточника, сделать рерайтинг, взять отдельные абзацы. Клоны можно разместить как на отдельных сайтах (на нормальных и обычных хостингах) так и на внутренних страницах сайтов. Можно частично проспамить клоны. Потом оцениваем результат умозрительно и делаем выводы.

- Определить принципы, по которым фильтруются «нечеткие дубликаты» можно по методике, описанной выше, т.е. просто путем анализа отфильтрованных сайтов.

6. Дополнительная литература

Дублированный контент или просто дубли - это страницы на вашем сайте, которые полностью (четкие дубли) или частично (нечеткие дубли) совпадают друг с другом, но каждая из них имеет свой URL. Одна страница может иметь как один, так и несколько дублей.

Как появляется дублированный контент на сайте?

Как для четких, так и для нечетких дублей есть несколько причин возникновения. Четкие дубли могут возникнуть по следующим причинам:

- Они появляются из-за CMS сайта. Например, с помощью replytocom в WordPress, когда добавление новых комментариев создает автоматом и новые страницы, отличающиеся только URL.

- В результате ошибок веб-мастера.

- Из-за изменения структуры сайта. Например, при внедрении обновленного шаблона с новыми URL.

- Делаются владельцем сайта для определенных функций. Например, страницы с версиями текста для печати.

Нечеткие дубли на вашем сайте могут появиться по следующим причинам:

Почему дублированный контент вредит сайту?

- Негативно влияет на продвижение в поисковой выдаче. Поисковые роботы отрицательно относятся к дублированному контенту и могут понизить позиции в выдаче из-за отсутствия уникальности, а следовательно, и полезности для клиента. Нет смысла читать одно и то же на разных страницах сайта.

- Может подменить истинно-релевантные страницы. Робот может выбрать для выдачи дублированную страницу, если посчитает ее содержание более релевантным запросу. При этом у дубля, как правило, показатели поведенческих факторов и/или ссылочной массы ниже, чем у той страницы, которую вы целенаправленно продвигаете. А это значит, что дубль будет показан на худших позициях.

- Ведет к потере естественных ссылок. Когда пользователь делает ссылку не на прототип, а на дубль.

- Способствует неправильному распределению внутреннего ссылочного веса. Дубли перетягивают на себя часть веса с продвигаемых страниц, что также препятствует продвижению в поисковиках.

Как проверить, есть у вас дубли или нет?

Чтобы узнать, есть у страниц сайта дубли или нет, существует несколько способов.

Нашли дубли? Читаем, как их обезвредить:

- 301-й редирект Этот способ считается самым надежным при избавлении от лишних дублей на вашем сайте. Суть метода заключается в переадресации поискового робота со страницы-дубля на основную. Таким образом, робот проскакивает дубль и работает только с нужной страницей сайта. Со временем, после настройки 301-ого редиректа, страницы дублей склеиваются и выпадают из индекса.

- Тег . Здесь мы указываем поисковой системе, какая страница у нас основная, предназначенная для индексации. Для этого на каждом дубле надо вписать специальный код для поискового робота , который будет содержать адрес основной страницы. Чтобы не делать подобные работы вручную, существуют специальные плагины.

- Disallow в robots.txt . Файл robots.txt - своеобразная инструкция для поискового робота, в которой указано, какие страницы нужно индексировать, а какие нет. Для запрета индексации и борьбы с дублями используется директива Disallow. Здесь, как и при настройке 301-го редиректа, важно правильно прописать запрет.

Как убрать дубли из индекса поисковых систем?

Что касается Яндекса, то он самостоятельно убирает дубли из индекса при правильной настройке файла robots.txt. А вот для Google надо прописывать правила во вкладке «Параметры URL» через Google Вебмастер.

Если у вас возникнут трудности с проверкой и устранением дублированного контента, вы всегда можете обратиться к нашим специалистам. Мы найдем все подозрительные элементы, настроим 301-й редирект, robots.txt, rel= "canonical", сделаем настройки в Google . В общем, проведем все работы, чтобы ваш сайт эффективно работал.

Дубликаты контента — одна из основных проблем низкого ранжирования сайта в поисковых системах. К данной проблеме приводит наличие на сайте страниц, которые полностью или частично идентичны друг другу. Естественно для поисковых систем наличие на сайте мусорных страниц представляет серьёзную проблему, так как приходится тратить на их обработку серверные мощности. Поисковым системам нет смысла тратить физические ресурсы на индексацию такого бесполезного контента. Поэтому они борются с такими сайтами, накладывая на них фильтр, либо занижает в ранжировании, что приводит к низким позициям по продвигаемым запросам.

Дубликаты и SEO

Наличие на сайте страниц дубликатов приводит к тому что:

- Полезный ссылочный вес распыляется на эти бесполезные страницы.

- Страница-дубликат после очередного апдейта вытесняет целевую страницу и та теряет позиции.

- Дублированный контент снижает уникальность всех страниц на которых он размещён.

- По мере того, как поисковая система борется с такими страницами, удаляя их из поиска — она может исключить и продвигаемую страницу.

Классификация дубликатов и решения по их устранению

Дубликаты бывают полными и частичными. Полные дубликаты — это когда страницы полностью идентичны. Соответственно, частичные дубли — это когда страницы совпадают не полностью. Полные дубликаты устраняют через robots.txt и настройку 301 редиректа. Частичные дубликаты устраняются путем проведения необходимых правок на сайте.

Привожу перечень чек-листов, которые нужно пройти, чтобы выявить и решить проблему дубликатов:

- Поиск дубликатов главной страницы сайта. Например, могут быть следующие варианты главной страницы: http://www.domen.com/, http://www.domen.com/index.php, http://www.domen.com, http://domen.com/, https://www.domen.com/, http://www.domen.com/index.html. Как видите вариантов много, но оптимальным является вариант http://www.domen.com/. Для устранения остальных копий главной страницы используется 301 редирект и закрытие в robots.txt (в случае с конструкциями вида https://www.domen.com/.

- Проверка фундаментального (золотого правила SEO) — каждая страница должна быть доступна только по одному адресу. Нельзя, чтобы адреса варьировались следующим образом: http://www.domen.com/stranica1/stranica2/ и http://www.domen.com/stranica2/stranica1/.

- Проверка на наличие переменных в урле. Их, в адрессе страницы, быть не должно. Например, генерация урлов вида: http://www.domen.ru/index.php?dir=4567&id=515 — это ошибка. Правильным будет следующий вариант урла: http://www.domen.ru/dir/4567/id/515.

- Проверка на наличие в урлах идентификаторов сессии. Например, урлы вида http://www.domen.ru/dir/4567/id/515.php?PHPSESSID=3451 — недопустимы. Такие урлы содержат бесконечное количество копий каждой страницы. Поэтому необходимо закрывать все идентификаторы сессий в robots.txt.